워싱턴이 Anthropic과의 협력 관계를 끊으면서 인공지능(AI)을 규율할 일관된 규칙이 전무하다는 사실이 드러났지만, 다당적 지식인 연합이 정부가 아직 제시하지 못한 무언가, 즉 책임 있는 AI 개발이 갖추어야 할 실질적인 틀을 마련했습니다.

<프로 휴먼 AI 선언문(Pro-Human AI Declaration)>은 지난주 국방부와 Anthropic 간의 대립 사태에 앞서 완성되었지만, 이 두 사건이 겹치면서 그 의미는 관련 당사자들 누구에게도 간과할 수 없는 수준이었습니다.

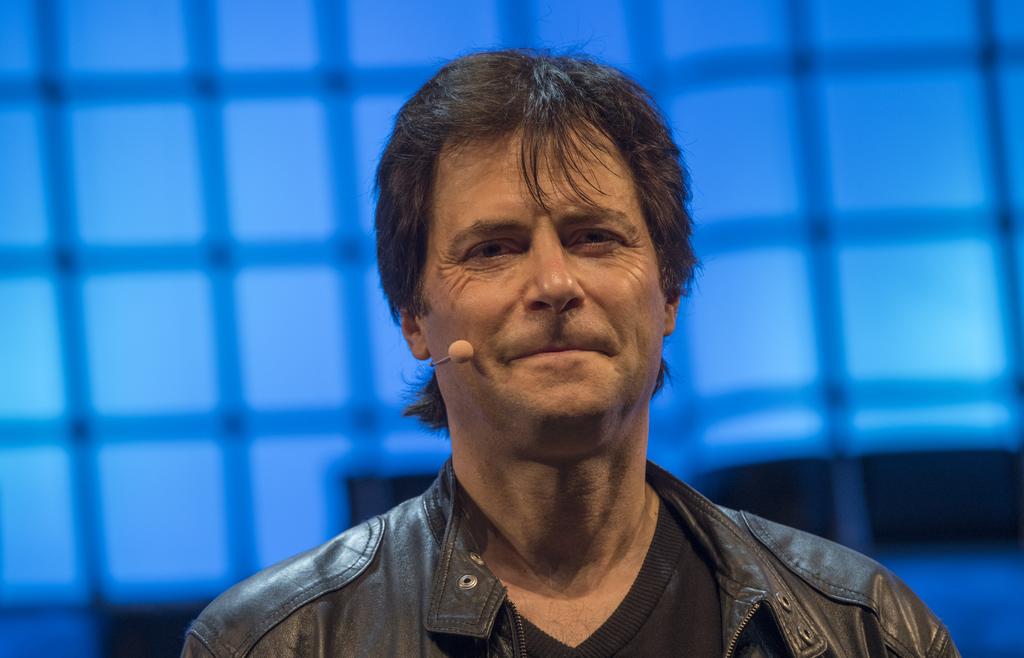

노력에 도움을 준 MIT 물리학자이자 AI 연구원인 맥스 테그마크는 이 편집자와의 대화에서 “지난 4개월 동안 미국에서 상당히 놀라운 일이 벌어졌습니다”라고 말하며, “여론조사 결과에 따르면 미국인 95%가 규제되지 않은 초지능 경쟁에 반대하고 있습니다”라고 언급했습니다.

수백 명의 전문가, 전직 공직자, 그리고 공인이 서명한 이 신규 문건은 인류가 갈림길에 섰다는 단도직입적인 관찰로 시작합니다. 선언문이 ‘대체 경쟁(the race to replace)’이라 부르는 한 경로는 인간이 먼저 노동자로서, 그다음 의사결정권자로서 대체되는 길이며, 이는 책임 소재가 모호한 기관과 그들의 기계에 권력이 집중되는 결과를 초래합니다. 다른 경로는 인간의 잠재력을 대폭 확장하는 AI로 나아갑니다.

후자의 시나리오는 다섯 가지 핵심 기둥에 의존합니다. 즉, 인간이 통제권을 유지하고, 권력의 집중을 피하며, 인간의 경험을 보호하고, 개인의 자유를 보존하며, AI 기업에 법적 책임을 묻는 것입니다. 이 선언문의 가장 강력한 조항 중에는 안전하게, 그리고 진정한 민주적 합의 하에 수행할 수 있다는 과학적 합의가 이루어질 때까지 초지능 개발을 전면적으로 금지하는 내용, 강력한 시스템에 대한 의무적인 강제 종료장치(off-switches) 설치 의무화, 그리고 자기 복제, 자율적 자가 개선, 혹은 종료 명령에 저항할 수 있는 구조(architecture)에 대한 금지 등이 포함되어 있습니다.

선언문의 발표는 그 긴급성을 더욱 절실하게 느끼게 하는 시점과 맞물렸습니다. 지난 2월 마지막 주 금요일, 국방장관 피트 헤그세스는 Anthropic—이미 기밀 군사 플랫폼에서 AI를 가동하고 있는 기업—을 “공급망 위험(supply-chain risk)”으로 지정했습니다. 이는 해당 회사가 국방부에 자사 기술의 무제한 사용을 허가하기를 거부한 뒤 내려진 조치였으며, 통상적으로 중국과 연관된 기업에만 부여되던 명칭입니다. 불과 몇 시간 후, OpenAI가 국방부와 자체 계약을 체결했지만, 법률 전문가들은 이 계약이 실질적인 방식으로 집행되기 어려울 것이라고 지적합니다. 이 일련의 사건들은 AI에 대한 의회의 태만(inertia)이 얼마나 큰 비용을 초래했는지 적나라하게 보여주었습니다.

미국 혁신재단(Foundation for American Innovation)의 수석 연구원인 딘 볼은 이후 뉴욕타임스에 “이것은 단순한 계약 분쟁이 아닙니다. 이것은 한 국가로서 AI 시스템에 대한 통제권에 대해 우리가 나누는 첫 대화입니다”라고 말했습니다.

테그마크는 우리와의 대화를 예로 들었습니다. “만약 우리가 신제품을 개발한다면, 시장이 수용할지, 아니면 너무 많은 비용이 들지 등 여러 측면을 고려해야 합니다.”

이러한 사고방식의 차이가 결국 어떤 위험을 초래할 수 있는지 설명했습니다.

그는 이처럼 인류가 새로운 기술을 접할 때마다 생기는 윤리적 고민을 강조하며, "지금까지는 큰 문제가 아니었던 것들이 나중에 엄청난 사회적 비용을 초래할 수 있다"고 지적했습니다.

전체적으로 그는 인류가 기술 발전에 따른 사회적 합의와 윤리적 고민을 게을리해서는 안 된다는 경고의 메시지를 전달했습니다.

[출처:] https://techcrunch.com/2026/03/07/a-roadmap-for-ai-if-anyone-will-listen