알리바바 및 홍산(구 시퀄리아 차이나) 등의 지원을 받은 중국의 문샷 AI(Moonshot AI)가 텍스트, 이미지, 비디오를 모두 이해할 수 있는 새로운 오픈 소스 모델 Kimi K2.5를 오늘 공개했습니다.

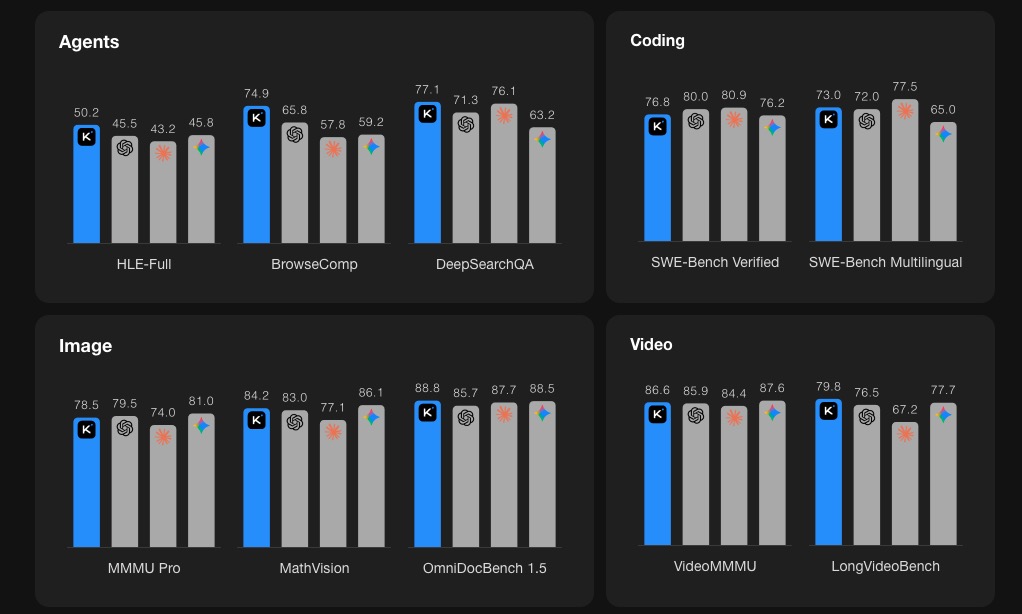

문샷 AI는 이 모델이 15조 개의 혼합 시각 및 텍스트 토큰으로 훈련되었기 때문에 '네이티브 멀티모달(natively multimodal)' 특성을 지닌다고 밝혔습니다. 또한 이 모델은 코딩 작업 수행 능력과 에이전트 스웜(agent swarms)—즉, 여러 에이전트가 협업하는 조율(orchestration)—처리 능력에 강점을 가지고 있다고 덧붙였습니다. 공개된 벤치마크에서 Kimi K2.5는 상업적 사설 모델들과 동등한 성능을 보였으며, 일부 작업에서는 이를 능가하는 결과도 기록했습니다.

예를 들어, 코딩 벤치마크에서 Kimi K2.5는 SWE-Bench Verified 벤치마크에서 Gemini 3 Pro를 앞질렀으며, SWE-Bench Multilingual 벤치마크에서는 GPT 5.2와 Gemini 3 Pro보다 높은 점수를 기록했습니다. 비디오 이해 분야에서는 모델이 비디오를 통해 추론하는 방식을 측정하는 VideoMMMU(비디오 대규모 다학제 멀티모달 이해) 벤치마크에서 GPT 5.2와 Claude Opus 4.5를 능가한 것으로 나타났습니다.

문샷 AI는 코딩 영역에서 이 모델이 텍스트 이해뿐만 아니라, 사용자가 이미지나 비디오를 입력하여 해당 미디어 파일에 표시된 것과 유사한 사용자 인터페이스를 생성하도록 요청할 수도 있다고 설명했습니다.

[창업자 장쩌린(Zhilin Yang)의 짧은 영상]

(직접 카메라 앞에서 연설하는 것은 처음이라, 여러분과 Kimi K2.5를 정말 공유하고 싶었어요!)

pic.twitter.com/2uDSOjCjly

— Kimi.ai (@Kimi_Moonshot)

2026년 1월 27일

이러한 코딩 기능을 일반 대중이 활용할 수 있도록, 회사는 Anthropic의 Claude Code나 Google의 Gemini CLI에 필적하는 오픈 소스 코딩 도구인 Kimi Code를 출시했습니다. 개발자들은 Kimi Code를 터미널에서 사용하거나 VSCode, Cursor, Zed와 같은 개발 소프트웨어와 연동할 수 있습니다. 해당 스타트업에 따르면, 개발자들은 Kimi Code에 이미지와 비디오를 입력 자료로 사용할 수 있습니다.

코딩 도구는 폭발적인 인기를 얻으며 AI 연구소의 주요 수익원(revenue driver)으로 자리매김하고 있습니다. 실제로 Anthropic은 지난 11월 Claude Code가 연간 반복 매출(ARR) 10억 달러에 달했다고 발표했으며, 이달 초 보도에 따르면 해당 도구는 2025년 말까지 이 수치에 1억 달러를 추가했다고 전해졌습니다. 한 보고서에 따르면, 문샷의 중국 경쟁사인 딥시크(DeepSeek)는 다음 달에 뛰어난 코딩 능력을 갖춘 새로운 모델을 출시할 예정입니다.

문샷 AI는 전 구글 및 메타 AI 연구원 출신이 설립했습니다. 이 회사는 25억 달러의 기업가치로 시리즈 B 라운드에서 10억 달러의 자금을 조달한 바 있습니다. 또 다른 보고서에 따르면, 이 스타트업은 지난달 43억 달러의 기업가치로 5억 달러를 확보했으며, 현재는 50억 달러의 기업가치로 다음 라운드의 자금 조달을 추진 중인 것으로 언급되었습니다.