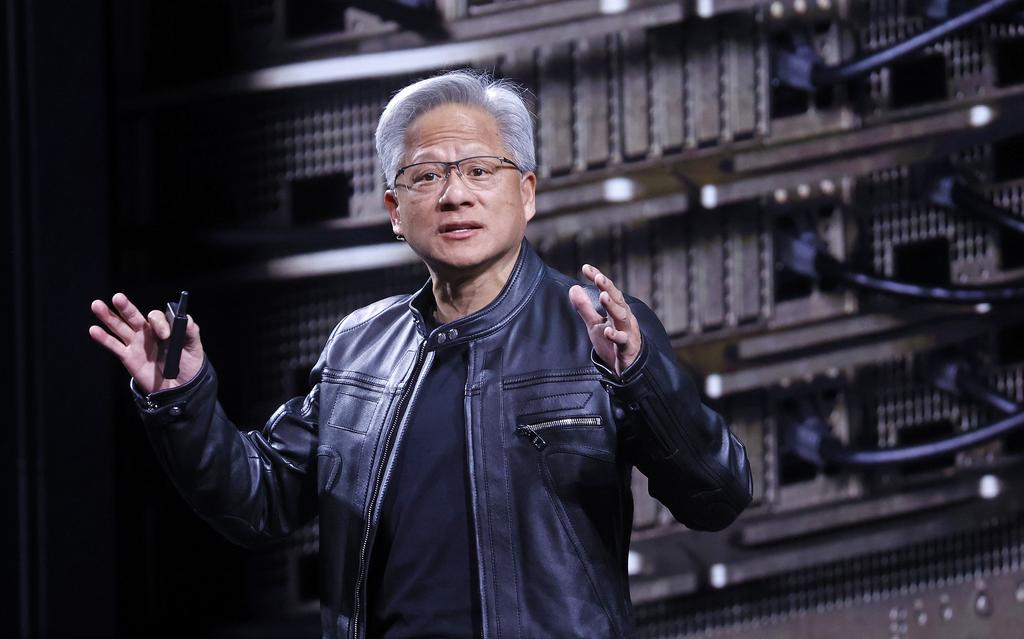

오늘 [날짜]에 엔비디아(Nvidia)의 젠슨 황(Jensen Huang) CEO는 회사의 새로운 루빈(Rubin) 컴퓨팅 아키텍처를 공식 출시했으며, 이를 AI 하드웨어의 최첨단 기술이라고 설명했다. 이 새로운 아키텍처는 현재 양산 단계에 있으며, 연말 하반기에는 생산량이 더욱 증가할 것으로 예상된다.

황 CEO는 청중에게 "베라 루빈은 우리가 직면한 근본적인 과제, 즉 AI에 필요한 컴퓨팅 양이 폭발적으로 증가하는 문제를 해결하기 위해 설계되었습니다"라고 말했다. 이어 "오늘 제가 말씀드릴 수 있는 것은 베라 루빈이 이미 완전한 생산 단계에 진입했다는 것입니다"라고 덧붙였다.

2024년 [날짜]에 처음 공개된 루빈 아키텍처는 엔비디아가 끊임없이 지속해 온 하드웨어 개발 주기의 최신 성과물이며, 이 과정은 엔비디아를 세계에서 가장 가치 있는 기업으로 탈바꿈시켰다. 루빈 아키텍처는 기존의 블랙웰(Blackwell) 아키텍처를 대체하며, 블랙웰 아키텍처는 다시 호퍼(Hopper) 및 로벨(Lovelace) 아키텍처를 대체한 것이다.

루빈 칩은 오픈AI(OpenAI)와의 주목할 만한 파트너십을 포함하여, 거의 모든 주요 클라우드 제공업체에서 사용될 예정이다. 또한 루빈 시스템은 HPE의 블루 라이언(Blue Lion) 슈퍼컴퓨터와 로렌스 버클리 국립 연구소(Lawrence Berkeley National Lab)의 차기 도드나(Doudna) 슈퍼컴퓨터에도 적용될 예정이다.

천문학자 베라 플로렌스 쿠퍼 루빈(Vera Florence Cooper Rubin)의 이름을 딴 루빈 아키텍처는 함께 작동하도록 설계된 6개의 독립적인 칩으로 구성되어 있다. 루빈 GPU가 핵심이지만, 이 아키텍처는 각각 블루필드(Bluefield) 및 NVLink 시스템의 개선을 통해 증가하는 스토리지 및 상호 연결성 병목 현상까지 해결한다. 또한, 이 아키텍처에는 에이전트형 추론(agentic reasoning)을 위해 특별히 설계된 새로운 베라(Vera) CPU도 포함되어 있다.

새로운 스토리지의 이점을 설명하면서, 엔비디아 AI 인프라 솔루션 수석 이사인 디온 해리스(Dion Harris)는 현대 AI 시스템의 증가하는 캐시 관련 메모리 수요를 지적했다.

해리스는 통화에서 기자들에게, AI 모델이 입력을 압축하는 데 사용되는 메모리 시스템인 KV 캐시를 언급하며, "에이전트형 AI나 장기 작업과 같은 새로운 유형의 워크플로우를 구현하기 시작하면 KV 캐시에 막대한 부담과 요구 사항이 발생합니다. 따라서 컴퓨팅 장치에 외부로 연결되는 새로운 계층의 스토리지를 도입하여 스토리지 풀을 훨씬 더 효율적으로 확장할 수 있게 되었습니다"라고 말했다.

예상대로, 새로운 아키텍처는 속도와 전력 효율성 측면에서도 큰 발전을 보여준다. 엔비디아의 테스트 결과에 따르면, 루빈 아키텍처는 모델 훈련 작업에서 이전 블랙웰 아키텍처보다 3.5배 빠르며, 추론 작업에서는 5배 빠르고, 최대 50 페타플롭스(petaflops)에 달하는 성능을 낼 수 있다. 이 새로운 플랫폼은 또한 와트당 8배 더 많은 추론 컴퓨팅을 지원할 것이다.

루빈의 새로운 역량은 AI 인프라 구축을 위한 치열한 경쟁 환경 속에서 나왔다. 이 경쟁으로 인해 AI 연구소와 클라우드 제공업체 모두 엔비디아 칩은 물론, 이들을 구동하는 시설 확보에 사활을 걸고 있다. 황 CEO는 2025년 10월 실적 발표 통화에서 향후 5년 동안 AI 인프라에 3조 달러에서 4조 달러 사이가 지출될 것으로 추정했다.

(참고: 이 내용은 TechCrunch의 2026년 1월 5일 보도 내용을 기반으로 하며, 젠슨 황 CEO가 AI 하드웨어의 최첨단이라 설명한 새로운 루빈 컴퓨팅 아키텍처가 공개된 기사다.)

[출처:] https://techcrunch.com/2026/01/05/nvidia-launches-powerful-new-rubin-chip-architecture