올해 초, 애플은 WWDC 2025에서 자사의 'Foundation Models' 프레임워크를 공개했습니다. 이 프레임워크는 개발자들이 회사의 로컬 AI 모델을 활용하여 애플리케이션 기능을 구현할 수 있도록 지원합니다.

애플은 이 프레임워크를 통해 개발자들이 추론 비용(inference cost) 걱정 없이 AI 모델에 접근할 수 있다고 강조했습니다. 또한, 이 로컬 모델들에는 가이드 생성(guided generation) 및 도구 호출(tool calling) 기능이 기본적으로 내장되어 있습니다.

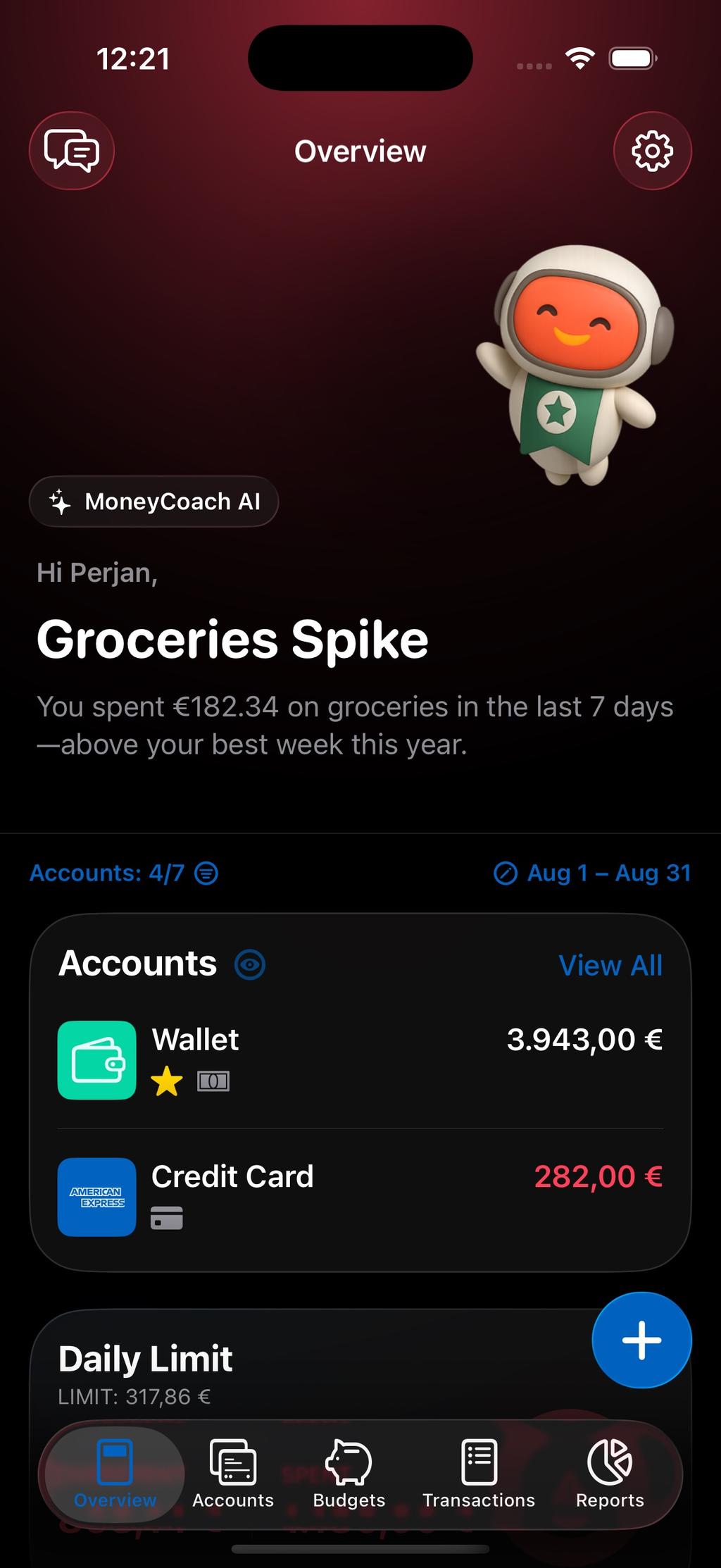

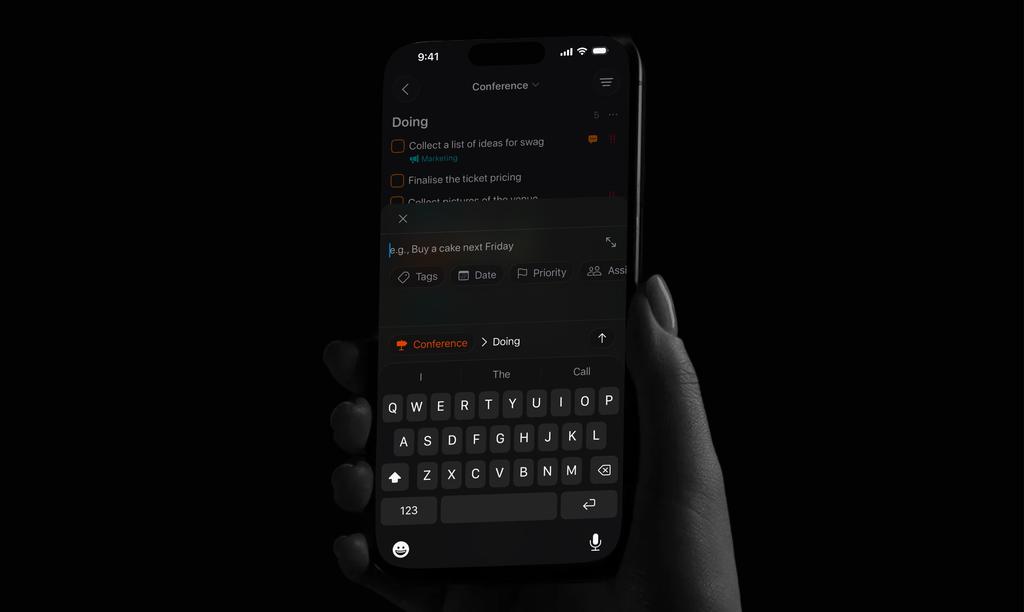

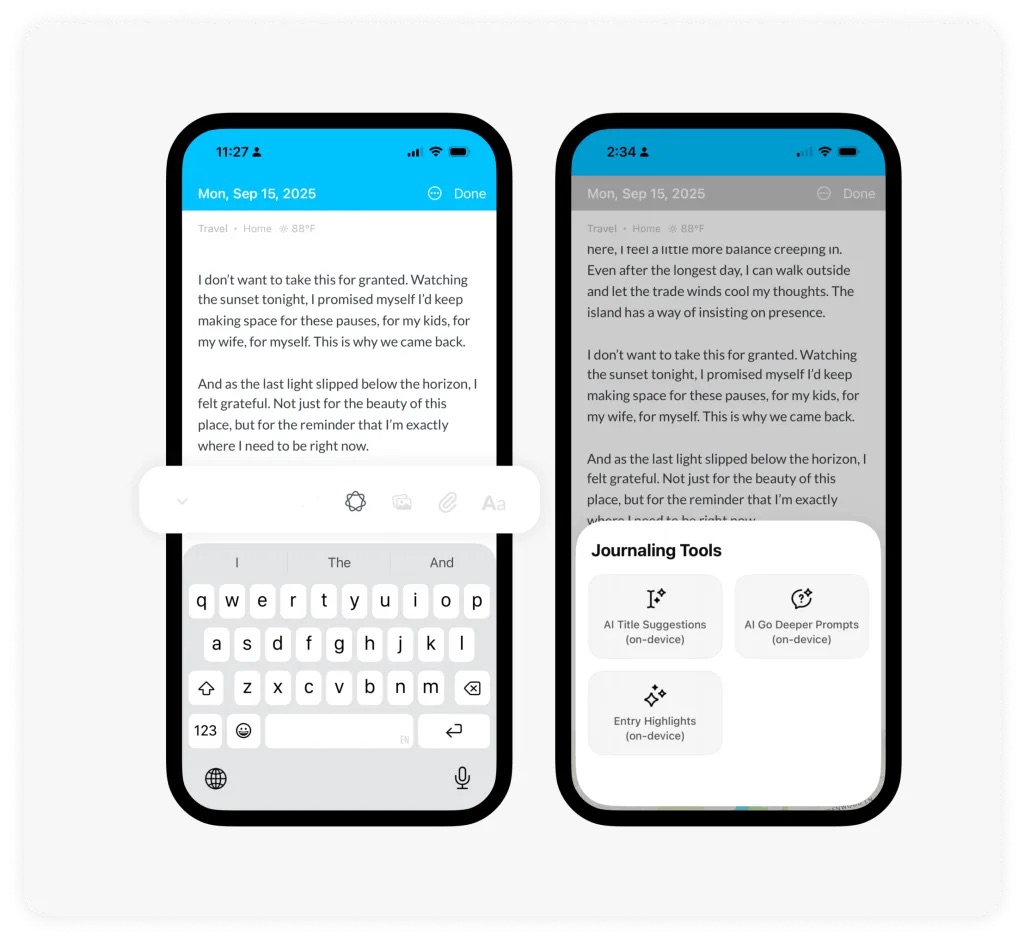

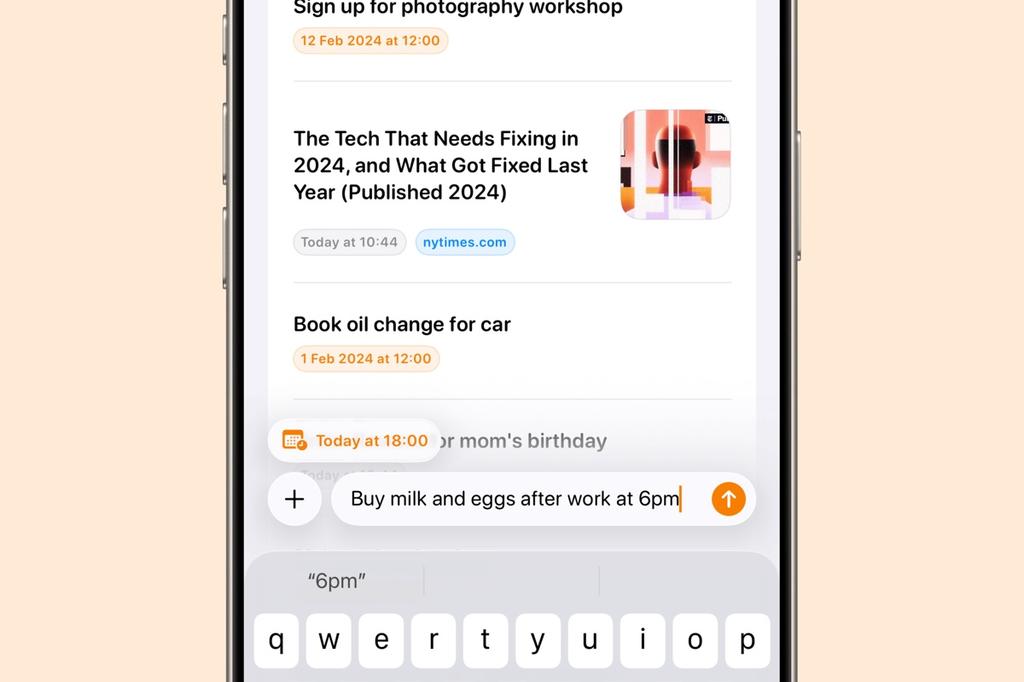

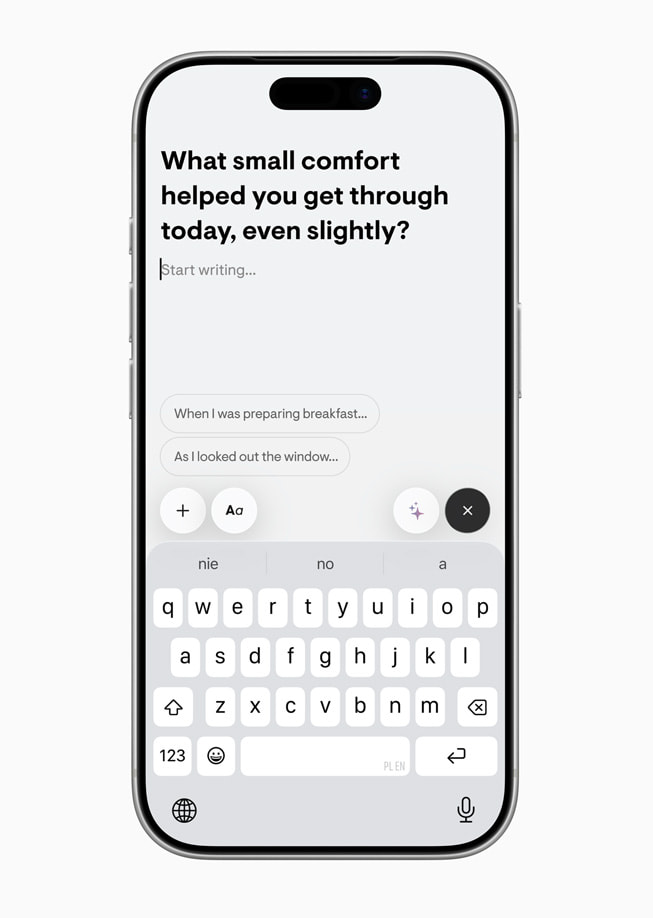

iOS 26이 모든 사용자에게 배포됨에 따라, 개발자들은 애플의 로컬 AI 모델 기반 기능을 포함하도록 앱들을 업데이트하고 있습니다. 애플의 모델들은 OpenAI, Anthropic, Google, 또는 Meta의 선도적인 주력 모델들과 비교했을 때 규모는 작지만, 사용자에게 유의미한 기능을 제공합니다.

주요 앱 업데이트 사례

1. 스토리텔링 앱 (Storytelling App)

사용자가 AI에게 주제와 스타일을 제시하여 즉시 이야기를 생성합니다. 사용자는 생성된 이야기의 특정 부분을 클릭하여 내용을 수정하거나, 특정 캐릭터의 말투를 변경해 이야기의 분위기를 조정할 수 있습니다.

2. 사진 편집 앱 (Photo Editing App)

사용자가 특정 물체를 가리키거나 텍스트로 설명하면, AI가 사진 속 해당 부분을 찾아내어 제거하거나 원하는 물체로 자연스럽게 대체해 줍니다. 또한, 사진의 전체적인 분위기(예: 빈티지, 영화 같은 느낌)를 선택하여 일괄적으로 조정할 수 있습니다.

3. 여행 플래너 앱 (Travel Planner App)

사용자가 여행 목적지, 여행 기간, 예산 등 기본적인 정보를 입력하면, AI가 추천 동선과 상세 일정을 짜줍니다. 특히, 실시간 교통 정보와 현지 이벤트 일정을 반영하여 유연하게 수정할 수 있는 '대체 일정' 기능을 제공합니다.

기술적 변화 및 발전 방향

애플은 장치 자체의 성능 향상(On-device AI)을 통해 사용자 개인 정보 보호를 강화하면서도 강력한 AI 기능을 구현하는 데 중점을 두고 있습니다.

- 프라이버시 중심 AI: 데이터를 클라우드로 전송하지 않고 기기 내에서 처리하는 온디바이스 AI 모델을 통해 사용자 프라이버시를 최우선으로 보호합니다.

- 다중 모달리티: 텍스트, 이미지, 음성 등 다양한 형태의 입력(Multi-modality)을 동시에 이해하고 처리하는 능력이 크게 향상되어, 더욱 직관적이고 인간적인 사용자 경험을 제공합니다.

- 상황 인식 능력: 사용자의 현재 위치, 시간, 주변 환경(날씨, 소음 등)을 종합적으로 파악하여, 사용자가 요청하기도 전에 필요한 정보나 기능을 능동적으로 제시하는 '예측적 인터페이스'를 구현합니다.

[출처:] https://techcrunch.com/2025/10/03/how-developers-are-using-apples-local-ai-models-with-ios-26