OpenAI, Google DeepMind, Anthropic 등 주요 AI 연구 그룹과 광범위한 기업 및 비영리 단체들은 화요일에 발표된 입장문을 통해 AI 추론 모델의 ‘사고 과정(thoughts)’을 모니터링하는 기술에 대한 심층 조사가 필요하다고 촉구했다.

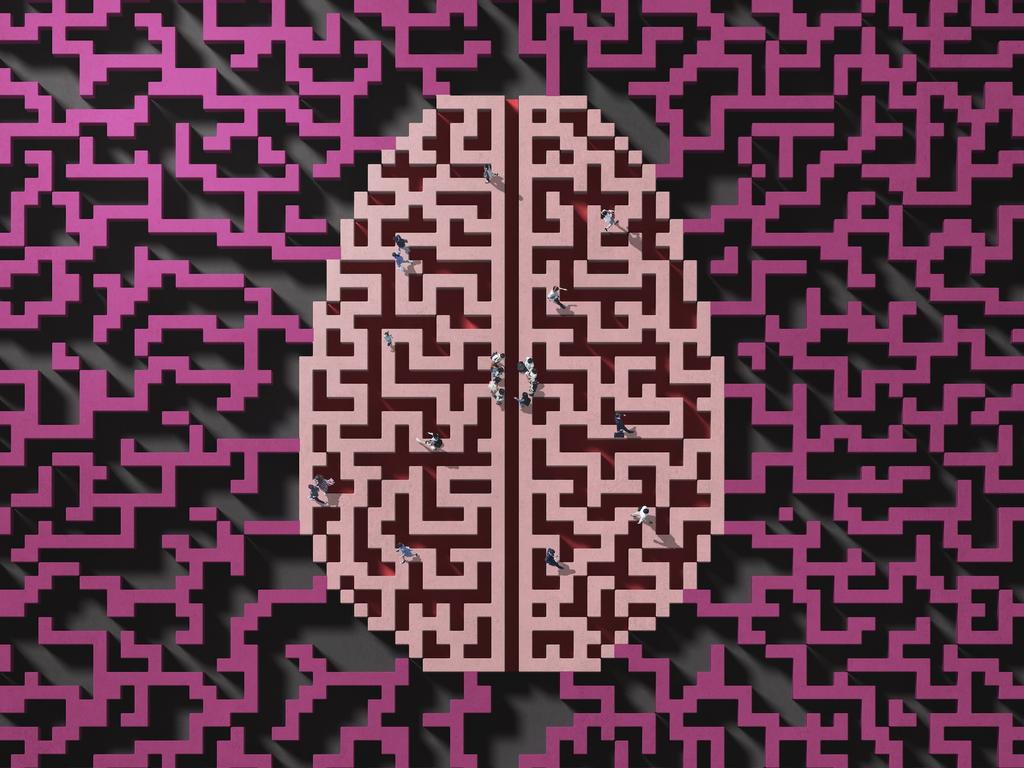

OpenAI의 o3나 DeepSeek의 R1과 같은 AI 추론 모델의 핵심 특징 중 하나는 '사고의 연쇄(chains-of-thought)' 또는 CoT이다. 이는 AI 모델이 복잡한 수학 문제에 접근할 때, 사람이 풀 과정을 스케치패드에 기록하며 푸는 것과 유사하게 문제를 해결하는 외현화된(externalized) 과정이다. 추론 모델은 AI 에이전트 구동의 핵심 기술이며, 논문 저자들은 CoT 모니터링이 AI 에이전트의 확산과 역량 증가에 따라 통제권을 유지할 수 있는 핵심 방법론이 될 수 있다고 주장한다.

연구원들은 해당 입장문에서 "CoT 모니터링은 최첨단 AI의 안전 장치에 귀중한 추가 기능을 제공하며, AI 에이전트가 의사결정을 내리는 방식에 대한 희소한 통찰력을 제공한다"고 밝혔다. 이어 "하지만 현재의 가시성이 지속된다는 보장은 없다. 따라서 우리는 연구 커뮤니티와 최첨단 AI 개발자들이 CoT 모니터링 가능성을 최대한 활용하고, 이를 어떻게 보존할 수 있을지 연구하기를 권장한다"고 강조했다.

이 입장문은 선도적인 AI 모델 개발사들에게 CoT를 ‘모니터링 가능하게’ 만드는 요소, 즉 AI 모델이 실제로 답에 도달하는 방식에 대한 투명도를 높이거나 낮출 수 있는 구체적인 요인들을 연구할 것을 요청한다. 논문 저자들은 CoT 모니터링이 AI 추론 모델을 이해하는 데 중요한 방법이 될 수 있다고 언급하면서도, 이 과정이 취약할 수 있음을 경고하며 투명성이나 신뢰도를 저해할 수 있는 어떠한 개입에도 주의를 당부했다.

또한 논문 저자들은 AI 모델 개발사들에게 CoT 모니터링 가능성을 지속적으로 추적하고, 이 방법이 궁극적으로 안전장치로 구현될 방안을 연구할 것을 촉구했다.

본 논문의 주요 서명자로는 OpenAI의 최고 연구 책임자 마크 첸(Mark Chen), Safe Superintelligence의 CEO 일리야 수츠케버(Ilya Sutskever), 노벨상 수상자 제프리 힌튼(Geoffrey Hinton), Google DeepMind 공동 창립자 셰인 레그(Shane Legg), xAI 안전 고문 단 헨드릭스(Dan Hendrycks), 그리고 Thinking Machines 공동 창립자 존 슐만(John Schulman) 등이 이름을 올렸다. 제1 저자는 영국 AI 보안 연구소(U.K. AI Security Institute)와 Apollo Research의 리더들로 구성되었으며, 다른 서명자들은 METR, Amazon, Meta, UC 버클리 등의 연구진들이다.

이번 논문은 AI 안전 분야 연구를 증진시키려는 노력에 있어 AI 업계 거물들이 단결된 모습을 보여준다. 이는 기술 기업들이 극심한 경쟁에 몰린 시점에 나온 것으로, 경쟁으로 인해 Meta가 OpenAI, Google DeepMind, Anthropic의 최고 연구원들을 수백만 달러에 영입하는 사태가 발생하기도 했다. 현재 가장 높은 수요를 보이는 연구원들은 AI 에이전트와 AI 추론 모델을 개발하는 인재들이다.

논문 작성에 참여한 OpenAI 연구원인 보웬 베이커(Bowen Baker)는 TechCrunch와의 인터뷰에서 "우리는 새로운 CoT라는 중요한 전환점에 서 있다. 매우 유용해 보이지만, 만약 사람들이 이 부분에 집중하지 않는다면 몇 년 안에 사그라질 수도 있다"고 말했다. 그는 "이 같은 입장문을 발표하는 것은 이런 일이 발생하기 전에 이 주제를 부각시키려는 시도"라고 덧붙였다.

한편, 논문은 이러한 연구의 필요성을 강조하며, 해석의 오류를 방지할 수 있는 방안이 중요하다고 지적한다.

[출처:] https://techcrunch.com/2025/07/15/research-leaders-urge-tech-industry-to-monitor-ais-thoughts