작년 Apple의 WWDC 기조연설은 인공지능(AI) 분야에서 회사가 보여준 야심찬 진전을 조명했습니다.

올해는 회사가 그 초점을 조율하여 운영체제, 서비스, 소프트웨어 업데이트에 중점을 두었으며, '새로운 미학'이라 명명한 스타일과 새로운 명칭 규칙을 도입했습니다.

그럼에도 불구하고 Apple은 이미지 분석 도구, 운동 코치, 실시간 번역 기능 등 몇 가지 AI 관련 발표를 통해 사용자들의 기대를 충족시키려 했습니다.

시각적 지능(Visual Intelligence)

시각적 지능은 주변 환경에 대한 정보를 수집할 수 있게 해주는 Apple의 AI 기반 이미지 분석 기술입니다. 예를 들어, 정원의 식물을 식별하거나, 식당에 대한 정보를 얻거나, 누군가 착용한 재킷을 인식하는 것이 가능합니다.

이 기능은 이제 사용자의 iPhone 화면 정보와 연동됩니다. 예를 들어, 소셜 미디어 앱에서 게시물을 발견했을 때, 시각적 지능은 사용자가 탐색하는 내용과 관련된 이미지 검색을 수행합니다. 이 도구는 Google 검색, ChatGPT 등과 연동하여 검색을 처리합니다.

시각적 지능을 사용하려면 '제어 센터'를 열거나 '액션 버튼'(일반적으로 스크린샷에 사용되는 버튼)을 사용자 지정해야 합니다. 해당 기능은 올해 하반기 출시되는 iOS 26에서 이용할 수 있습니다.

ChatGPT가 Image Playground에 통합되다

Apple은 AI 기반 이미지 생성 도구인 Image Playground에 ChatGPT를 통합했습니다. ChatGPT 덕분에 이 앱은 '애니메이션', '유화', '수채화'와 같은 새로운 스타일로 이미지를 생성할 수 있습니다. 또한, ChatGPT에 프롬프트를 전송하여 추가 이미지를 생성하도록 요청할 수 있는 옵션도 제공됩니다.

AI 기반 운동 코치

Apple의 최신 AI 기반 운동 코치는 이름 그대로 작동합니다. 운동하는 동안 텍스트 음성 변환(Text-to-Speech) 모델을 사용해 개인 트레이너가 격려하는 듯한 목소리로 사용자에게 동기 부여 메시지를 전달합니다. 달리기를 시작하면, 운동 앱 내의 AI가 최고 기록 마일이나 평균 심박수 같은 핵심 순간을 강조하며 동기 부여 멘트를 제공합니다. 운동을 마친 후에는, AI가 평균 페이스, 심박수, 그리고 주요 마일스톤 달성 여부 등을 요약해 줍니다.

Apple Intelligence를 활용한 실시간 번역

Apple Intelligence는 Messages, FaceTime, 전화 통화에 새로운 실시간 번역 기능을 제공합니다. 이 기술은 텍스트 또는 음성으로 입력된 내용을 사용자가 지정한 언어로 실시간 자동 번역합니다. FaceTime 통화 중에는 라이브 자막 형태로 자막이 표시되며, 일반 전화 통화의 경우 Apple이 대화를 음성으로 번역해 줍니다.

알 수 없는 발신자에 대한 AI 도움

Apple은 전화 통화를 위한 두 가지 새로운 AI 기능을 도입했습니다. 첫 번째는 '통화 스크리닝(Call Screening)' 기능으로, 알 수 없는 번호의 전화를 백그라운드에서 자동으로 수신하여 거르도록 돕습니다. 이를 통해 사용자는 전화를 받기 전 발신자의 이름과 통화 목적을 미리 파악할 수 있습니다.

두 번째 기능인 '홀드 어시스트(Hold Assist)'는 콜센터 대기 중 자동 연결 음악이 흘러나올 때 이를 감지합니다. 사용자는 대기 상태를 유지하도록 선택하여 다른 작업을 할 수 있으며, 실시간 상담원이 연결되면 알림을 받게 됩니다.

Messages의 설문조사 기능

Apple은 또한 Messages 앱 내에서 사용자 간 설문조사 기능을 추가했습니다. 이 기능은 Apple Intelligence를 활용하여 대화의 맥락에 기반한 설문조사를 제안합니다. 예를 들어, 그룹 채팅방에서 모두가 식사 장소를 결정하는 데 어려움을 겪을 경우, Apple Intelligence가 합의를 돕기 위해 설문조사 시작을 추천할 수 있습니다.

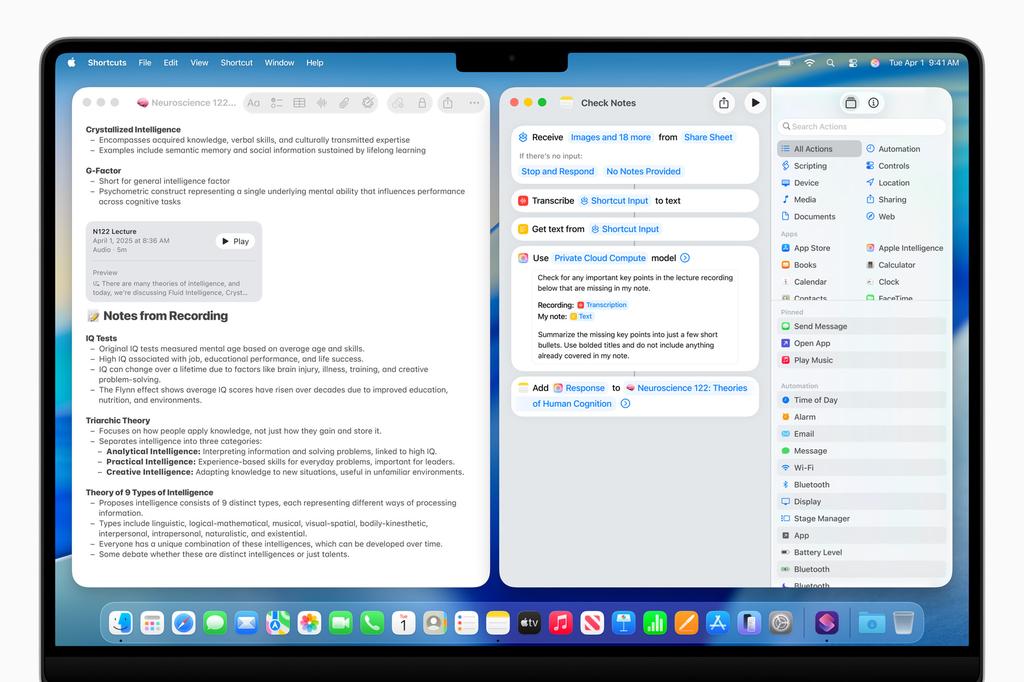

AI 기반 단축어 (Shortcuts)

단축어 앱은 Apple Intelligence를 통해 더욱 강력해졌습니다. 회사는 사용자들이 단축어를 구축할 때 AI 모델을 선택하여 AI 요약과 같은 기능을 활성화할 수 있을 것이라고 설명했습니다.

상황 인지 스포트라이트 (Contextually aware Spotlight)

Mac의 온디바이스 검색 기능인 스포트라이트가 업데이트되었습니다. 이제 스포트라이트는 Apple Intelligence를 통합하여 상황 인지 능력을 개선합니다. 사용자들의 일반적인 작업 패턴과 현재 작업에 맞는 맞춤형 제안을 제공할 예정입니다.

개발자를 위한 파운데이션 모델 (Foundation Models)

Apple은 이제 개발자들이 오프라인 상태에서도 자사의 AI 모델에 접근할 수 있도록 허용합니다. 회사는 '파운데이션 모델(Foundation Models)' 프레임워크를 도입하여, 개발자가 Apple의 기존 시스템을 활용하는 서드파티 앱에 더 폭넓은 AI 기능을 구축할 수 있게 했습니다. 이는 Apple이 경쟁하는 AI 시장에서 개발자들이 새로운 AI 기능을 창출하도록 장려하기 위한 전략으로 풀이됩니다.

Apple의 AI 기반 Siri 관련 지연

이번 행사에서 가장 아쉬운 소식은 기대를 모았던 Siri 관련 발전 사항이 아직 준비되지 않았다는 점입니다. 참석자들은 약속된 AI 기반 기능들의 구현을 기대하며 열광했지만, Apple의 소프트웨어 엔지니어링 수석 부사장(SVP of Software Engineering) 크레이그 페데리기(Craig Federighi)는 관련 내용을 내년이 되어야 더 많이 공개할 수 있다고 밝혔습니다. 이러한 지연은 점점 더 경쟁이 심화되는 시장에서 음성 비서에 대한 Apple의 전략에 의문을 제기할 수 있습니다.

[출처:] https://techcrunch.com/2025/06/12/here-are-apples-top-ai-announcements-from-wwdc-2025