데이터 센터 공격 범위 확대

AI 요약 및 핵심 요약

이 기사의 핵심 요약:

이 기사의 핵심 요약:

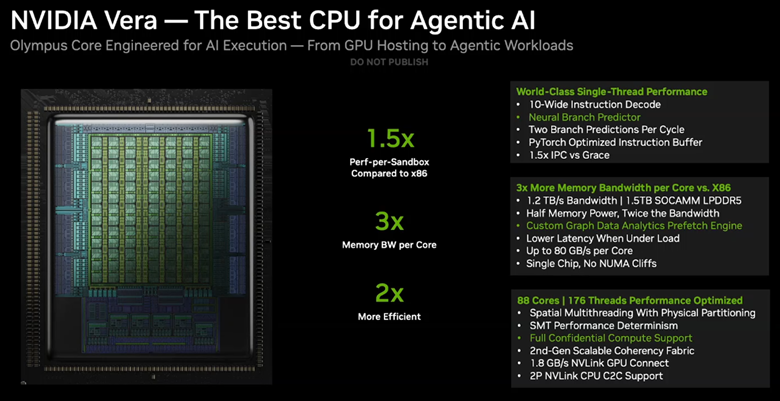

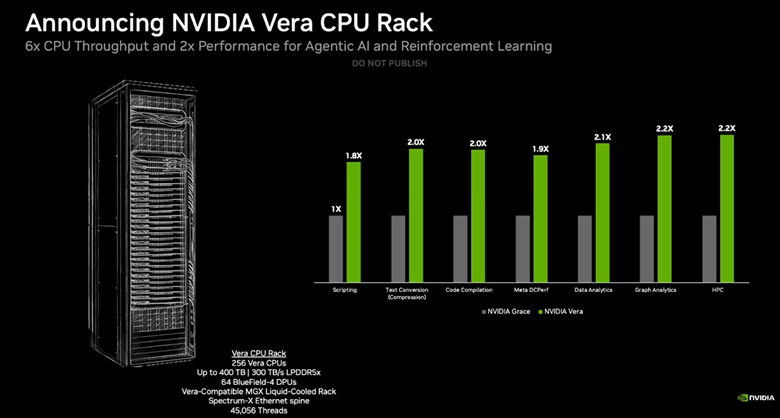

엔비디아(NVIDIA)가 차세대 고성능 컴퓨팅을 위한 차세대 CPU 아키텍처를 발표했습니다. 이 새로운 프로세서는 전작 대비 성능 향상에 초점을 맞추었으며, 특히 AI 워크로드와 데이터센터 환경에 최적화되었습니다. 가장 큰 변화는 아키텍처의 유연성과 전력 효율성 개선에 기여하는 여러 혁신 기술이 도입되었다는 점입니다. 이 CPU는 향후 AI 모델 학습 및 추론 시장을 주도할 핵심 인프라가 될 것으로 기대됩니다.

주요 내용별 요약 (Key Takeaways):

주요 내용별 요약 (Key Takeaways):

- AI/HPC 최적화: 새로운 CPU는 순수 컴퓨팅 성능뿐만 아니라, AI 딥러닝 워크로드와 고성능 컴퓨팅(HPC) 작업에 특화되어 설계되었습니다.

- 아키텍처 혁신: 단순히 클럭 속도만 높인 것이 아니라, 전력 효율성(Performance per Watt)과 메모리 대역폭 최적화 등 근본적인 아키텍처 개선을 이루어냈습니다.

- 확장성 및 유연성: 다양한 워크로드를 지원하도록 설계되어, AI 학습(Training)부터 실제 서비스 구동(Inference)까지 전 라이프사이클에 걸쳐 효율적으로 활용 가능합니다.

- 시장 전망: 이 제품은 엔비디아의 데이터센터 생태계를 더욱 강화하며, AI 산업의 폭발적인 성장에 대비하는 핵심적인 하드웨어 솔루션을 제공할 것입니다.

비교 분석 (What's New?):

비교 분석 (What's New?):

| 영역 | 이전 세대 대비 개선점 | 기술적 의미 |

|---|---|---|

| 성능 | 전반적인 처리 능력 향상 | 더 복잡하고 큰 AI 모델 처리가 원활해짐. |

| 전력 효율성 | Watts당 성능 (Performance per Watt) 극대화 | 데이터센터 운영 비용(OPEX) 절감에 기여하며 친환경적. |

| 아키텍처 | 메모리 인터커넥트 최적화 | 데이터 병목 현상을 줄여, 대용량 데이터 처리가 지연 없이 이루어짐. |

| 적용 분야 | 학습(Training) 및 추론(Inference) 최적화 | 모델 개발 초기 단계부터 서비스 배포까지 전 과정 지원. |