칩렛 기반 가속기는 학습(훈련) 워크로드에 최적화된 GPU보다 AI 추론을 더 효율적으로 실행하도록 설계되었습니다.

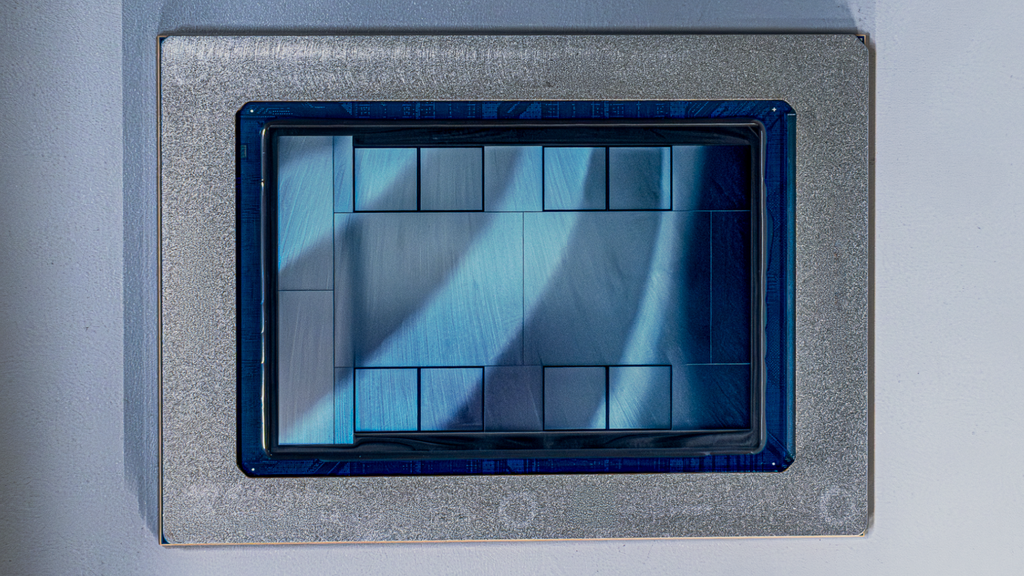

Meta는 자사 개발 AI 가속기인 Meta Training and Inference Accelerator(MTIA) 칩의 네 세대에 걸친 모델을 발표했습니다. 이 칩들은 모두 Broadcom과의 파트너십을 통해 개발되었으며, 향후 2년 내에 배치될 예정입니다. Meta는 보도 자료를 통해 "MTIA의 경쟁력 있는 전략을 개발하는 과정에서 빠른 반복 개발을 우선시하고, 추론(Inference) 기능에 집중하며, 업계 표준을 기반으로 설계하여 원활하게 채택할 수 있도록 했다"고 밝혔습니다.

참고 기사:

- 칩 제조 공급망 심층 분석

- TSMC의 1,650억 달러 규모 미국 투자 검토

- 중국, EUV 장비 역설계 의혹

네 가지 신규 칩은 MTIA 300, 400, 450, 그리고 500입니다. MTIA 300은 이미 랭킹 및 추천 학습용으로 생산되고 있으며, MTIA 400은 데이터 센터 배포를 앞두고 현재 실험실 테스트를 거치고 있습니다. MTIA 450과 500은 각각 2027년 초와 2027년 후반에 걸쳐 AI 추론 시장을 목표로 양산 배치될 예정입니다.

Meta의 기술 블로그에 따르면, MTIA 300부터 MTIA 500까지 HBM 대역폭은 4.5배 증가하고, 컴퓨팅 FLOPs는 25배 증가합니다. Meta는 MTIA 450이 MTIA 400 대비 HBM 대역폭을 두 배로 높여 "기존의 선도적인 상용 제품보다 훨씬 높다"고 설명했는데, 이는 엔비디아(Nvidia)의 H100 및 H200 대비 수준입니다. MTIA 500은 여기서 추가로 450 대비 HBM 대역폭을 50% 더 높이고, HBM 용량은 최대 80% 증가시켰습니다.

실제로 트랜스포머 추론의 디코드(decode) 단계에서 주된 병목 현상은 순수 FLOPs가 아니라 HBM 대역폭입니다. 기존의 주류 GPU들은 대규모 사전 학습(pre-training)에 초점을 맞춰 FLOPs를 극대화하도록 설계되어 있어, 추론 워크로드에는 불필요한 비용과 전력 오버헤드를 수반한다는 것이 Meta의 주장입니다.

(기술 사양 표는 원본과 동일하게 유지)

| MTIA 300 | MTIA 400 | MTIA 450 | MTIA 500 | |

|---|---|---|---|---|

| Workload Focus | R&R Training | General | AI Inference | AI Inference |

| Module TDP | 800 W | 1,200 W | 1,400 W | 1,700 W |

| HBM Bandwidth | 6.1 TB/s | 9.2 TB/s | 18.4 TB/s | 27.6 TB/s |

| HBM Capacity | 216 GB | 288 GB | 384-512 GB | - |

| MX4 Performance | 12 PFLOPS | 21 PFLOPS | 30 PLOPS | - |

| FP8/MX8 Performance | 1.2 PFLOPS | 6 PFLOPS | 7 PFLOPS | 10 PFLOPS |

| BF16 Performance | 0.6 PLOPS | 3 PFLOPS | 3.5 PLOPS | 5 PFLOPS |

Meta의 접근 방식에는 FlashAttention 및 Mixture-of-Experts 피드포워드 네트워크 연산을 위한 하드웨어 가속 기능과, 추론에 맞춰 공동 설계된 맞춤형 저정밀도 데이터 유형이 포함되어 있습니다. 특히 MTIA 450은 MX4를 지원하여 FP16/BF16 대비 6배 높은 MX4 FLOPs를 제공하며, 데이터 유형 변환에 따른 소프트웨어 오버헤드를 방지하는 혼합 저정밀도 연산이 가능합니다.

배포 관점에서 MTIA 400, 450, 500은 모두 동일한 섀시, 랙, 네트워크 인프라를 사용하도록 설계되어, 각 신규 칩 세대를 기존 물리적 공간에 맞춰 쉽게 교체할 수 있습니다. Meta는 이러한 모듈성 덕분에 MTIA의 칩 개발 주기가 약 6개월에 달한다고 밝히며, 이는 업계 일반적인 1~2년 주기를 훨씬 앞당긴 것입니다.

소프트웨어 스택은 PyTorch, vLLM, Triton에서 네이티브로 구동되며, torch.compile과 torch.export 기능을 지원합니다. 이 덕분에 프로덕션 모델을 MTIA 전용으로 별도 재작성할 필요 없이 GPU와 MTIA 모두에 동시에 배포할 수 있습니다. Meta는 이미 오가닉 콘텐츠 및 광고 추론을 위해 전반의 앱에 걸쳐 수십만 개의 MTIA 칩을 배치했다고 밝혔습니다.

이러한 발표는 Meta가 AMD와 장기적인 1,000억 달러 규모의 AI 인프라 계약을 공개한 지 불과 2주 만에 이루어졌습니다. 이는 Meta가 AI 스택의 다양한 영역에서 엔비디아 의존도를 낮추려는 광범위한 노력의 일환이며, MTIA를 추론 워크로드의 핵심으로 자리매김하려는 전략을 시사합니다.

Meta의 새로운 MTIA 라인업, 하이퍼스케일러들의 전용 칩 경쟁에 힘을 실어주다.