6개월 만에 33%의 용량 증가는 인상적인 성과입니다.

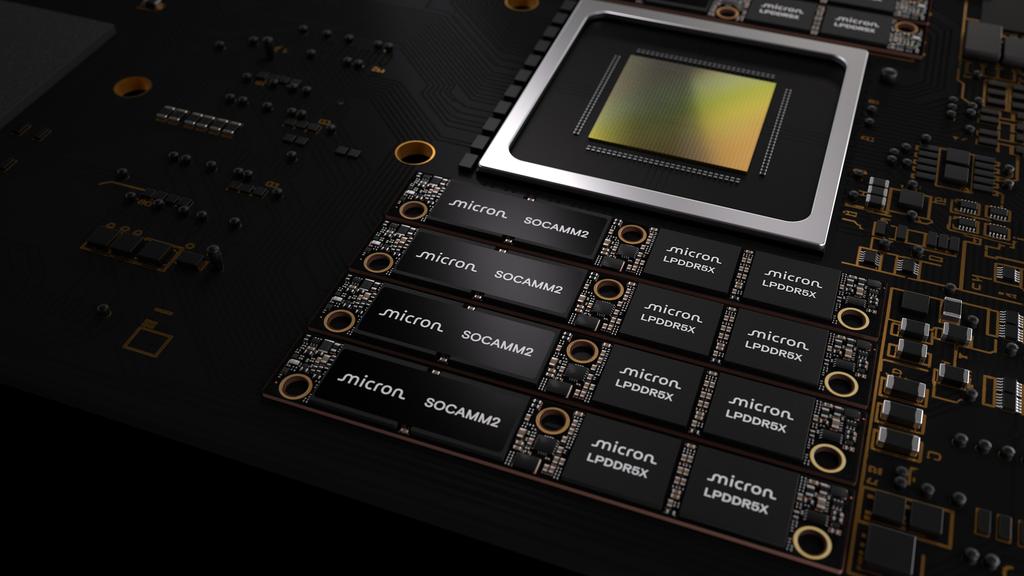

AI 데이터센터의 속도 관련 논의는 주로 가속기 자체에 집중되어 토큰당 초(tokens per second) 같은 지표를 다룹니다. 하지만 AI 성능 경쟁은 여러 전선에서 벌어지고 있으며, 그중 핵심 축 중 하나는 메모리 용량과 전력 효율성입니다. 마이크론(Micron)은 오늘 업계 최초로 보이는 256 GB SOCAMM2 유닛을 공개했는데, 이는 불과 6개월 전 출시된 최고 사양의 192 GB 모듈 대비 상당한 발전입니다.

AI 데이터센터, 전 세계 메모리 및 스토리지 공급을 잠식하다

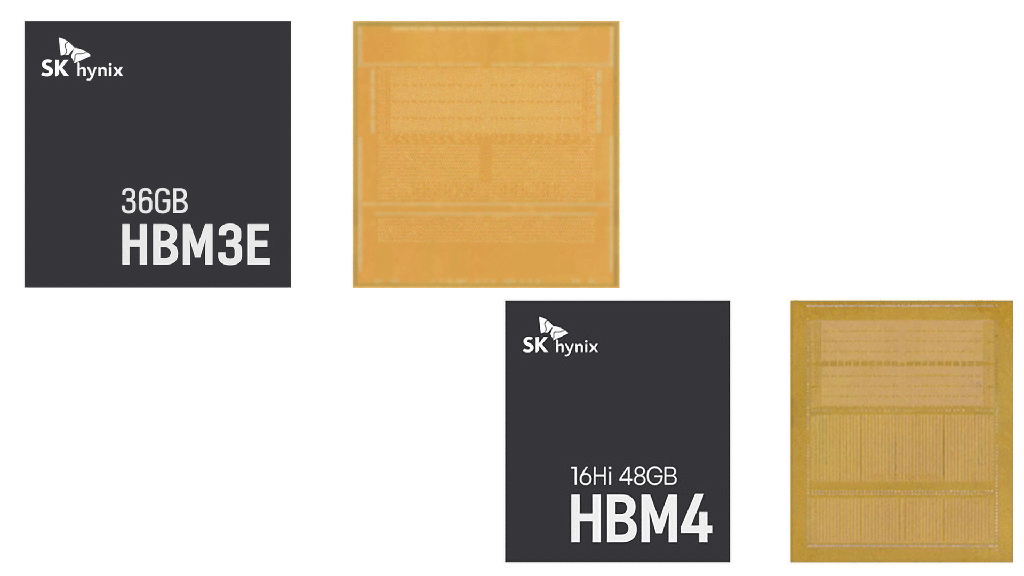

고대역폭 메모리 로드맵

마이크론은 현재 이 샘플을 고객사에 출하하고 있으며, 고객들이 각 CPU에 2TB의 메모리를 연결할 수 있게 되었다는 점에 큰 만족감을 느낄 것이라고 밝혔습니다. 대표적인 예로, 일반적인 엔비디아(Nvidia) NVL72 랙은 이제 36개의 CPU에 72TB의 RAM을 탑재할 수 있게 되었습니다.

이 새로운 SOCAMM2는 이전 세대 대비 밀도가 33% 향상된 것만으로도 훌륭한 소식이지만, 이 폼 팩터의 장점은 여기에만 그치지 않습니다. 새로운 모듈은 기존 표준 RDIMM 대비 66% 향상된 전력 효율성을 제공할 것으로 예상되며, AI 서버에 필수적이고 점차 일반화되고 있는 액체 냉각 기술과도 호환됩니다.

마이크론, 차량용 RAM은 300GB에 달할 것이라 예측

올해 메모리는 하이퍼스케일 데이터센터 지출의 30%를 차지할 전망이며, 이는 2023년 대비 4배 증가한 수치입니다.

마이크론에 따르면, 이번에 공개된 새로운 메모리 스틱은 모든 메모리 및 관련 회로가 단일 다이에 통합된(monolithic) 32 Gb(4 GB) LPDDR5X 모듈을 최초로 적용한 제품입니다.

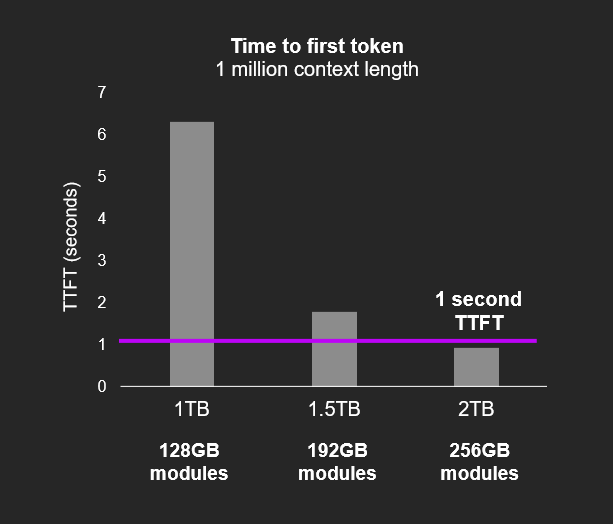

이 대용량 SOCAMM2가 겨냥하는 시장을 고려할 때, 마이크론은 단순한 밀도 및 전력 효율성을 넘어선 실제 성능 향상에 주목합니다. 단일 프로세서에 많은 RAM을 제공한다는 것은 AI 모델이 훨씬 더 큰 컨텍스트 윈도우를 사용할 수 있음을 의미합니다. 결과적으로는 매우 중요한 TTFT(Time To First Token, 첫 토큰 생성까지의 시간)를 줄이는 데 도움이 되어, 챗봇이 사용자 질문에 더 빠르게 응답하기 시작합니다.

컨텍스트 자체가 전부인 AI 시대에는, 시스템 내 xPU에 가까운 메모리 기가바이트 하나하나가 중요하며, 기업들이 AI 초격차 경쟁을 위해 수천억 달러 규모의 자본 지출(Capex)을 투입함에 따라, 마이크론의 이번 발전은 전 세계 대규모 AI 서버 구축 현장에서 의심할 여지 없이 활용될 것입니다.

SOCAMM2 폼 팩터는 엔비디아와 마이크론, 삼성, SK하이닉스와 같은 메모리 제조업체 간의 협력의 산물입니다. SOCAMM 표준은 원래 엔비디아가 설계했으나, 가속기 분야의 거물이었던 창업자는 고밀도 서버 환경에서 모듈이 과열 없이 작동시키는 데 어려움을 겪었습니다. 젠슨 황(Jensen Huang) CEO는 컴퓨터 메모리 분야의 전문가들과 협력하여, 밀도를 높이고 전력 소비를 낮춘 SOCAMM2를 탄생시키는 데 성공했습니다.

(※ 독자 여러분께 최신 뉴스, 분석 및 리뷰를 받아보시려면 Google News의 Tom's Hardware를 팔로우하거나 즐겨찾는 출처로 추가해 주세요.)