엔비디아의 차세대 플랫폼 심층 분석

제공된 텍스트는 엔비디아(NVIDIA)의 차세대 AI 컴퓨팅 플랫폼, 특히 루비(Rubin) 아키텍처 기반의 시스템을 중심으로 매우 광범위하고 기술적으로 깊은 수준의 정보를 담고 있습니다. 이 내용은 AI 인프라 구축 계획, 네트워킹, 컴퓨팅 성능 향상에 관한 업계의 최신 동향을 포괄적으로 설명하고 있습니다.

핵심 내용을 몇 가지 범주로 정리하고 간결하게 요약해 드립니다.

핵심 요약 및 분석

핵심 요약 및 분석

이 문서는 세 가지 주요 축을 중심으로 설명됩니다: 컴퓨팅(AI 칩), 인터커넥트(네트워킹), 그리고 전체 시스템 아키텍처입니다.

1. 컴퓨팅 파워 (AI 가속기)

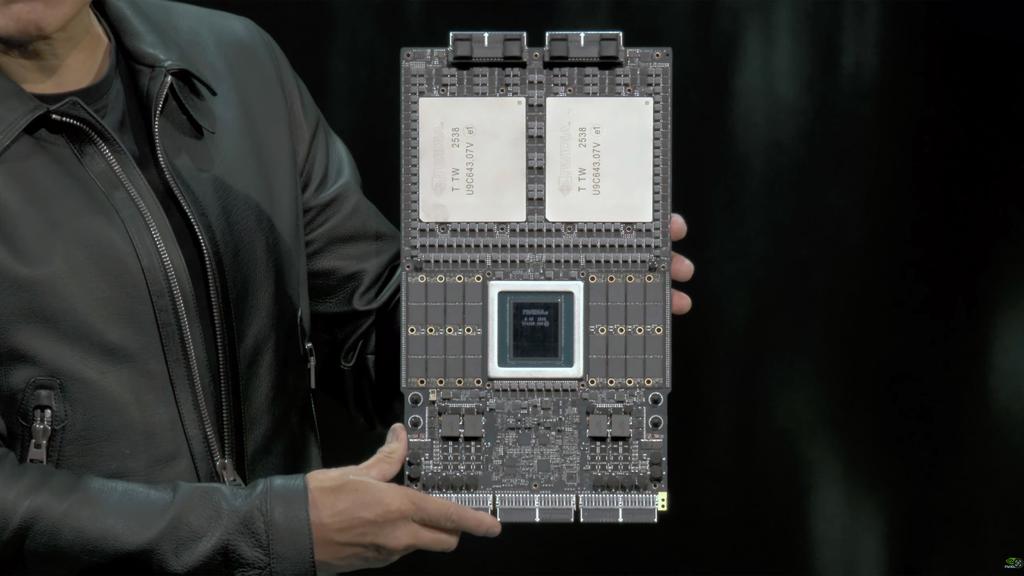

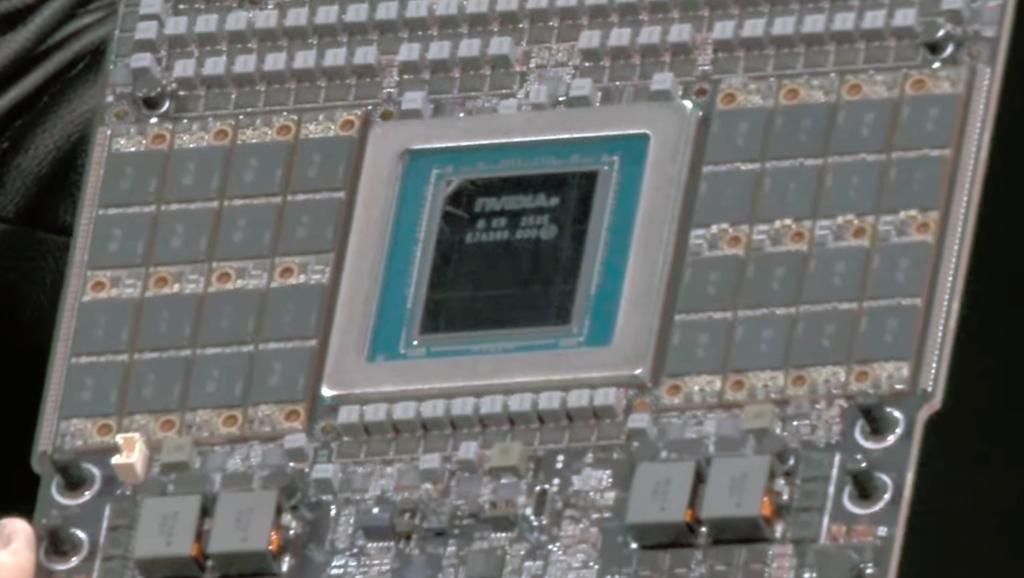

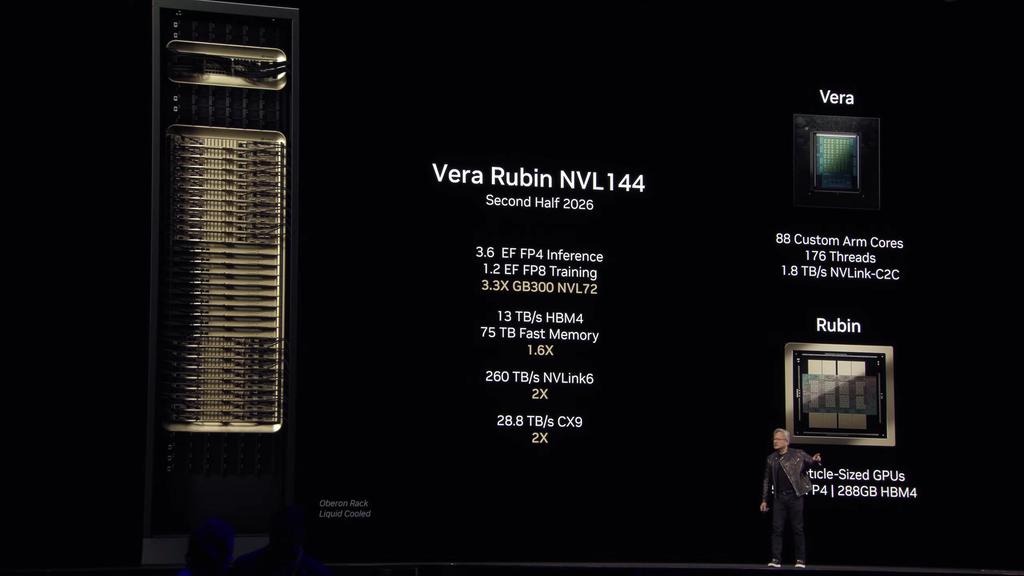

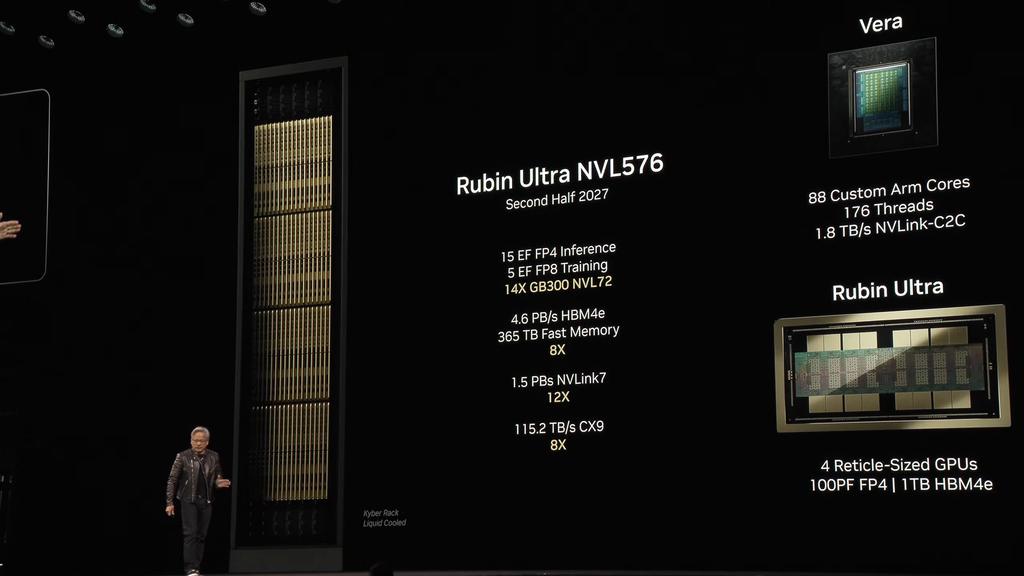

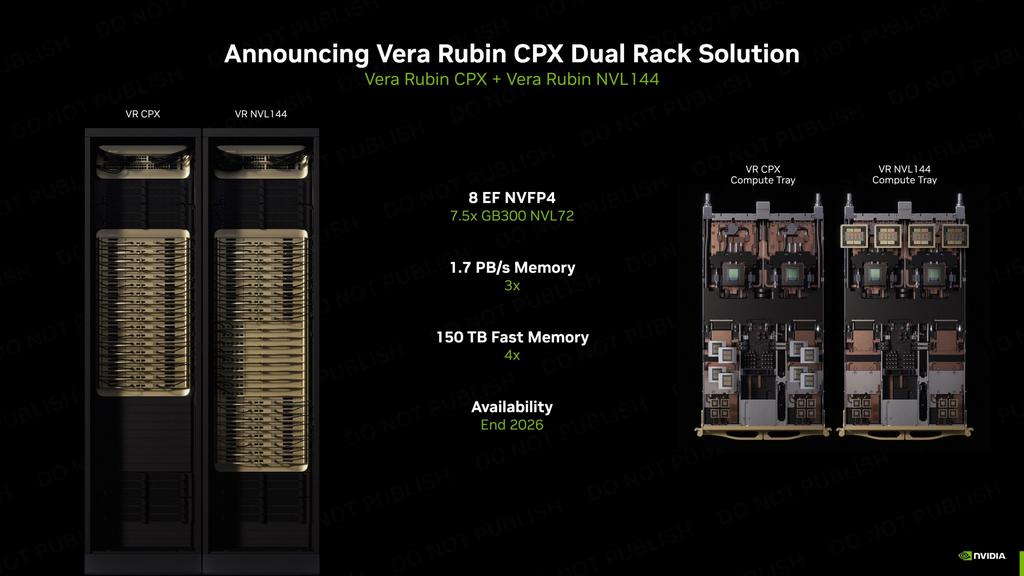

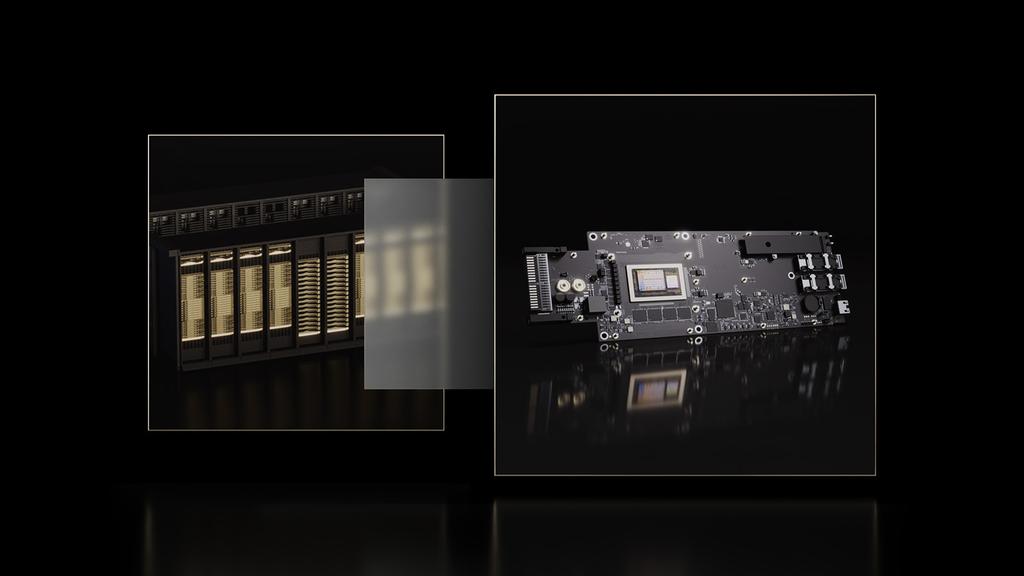

- 아키텍처: 루비(Rubin) 기반의 차세대 AI 칩이 핵심 동력입니다.

- 핵심 기능: 대규모 언어 모델(LLM) 추론 및 학습 워크로드를 극대화하는 데 중점을 둡니다.

- 특징: 고성능 연산을 통해 AI 데이터센터의 효율성과 용량을 크게 높입니다.

2. 네트워킹 및 인터커넥트 (연결성)

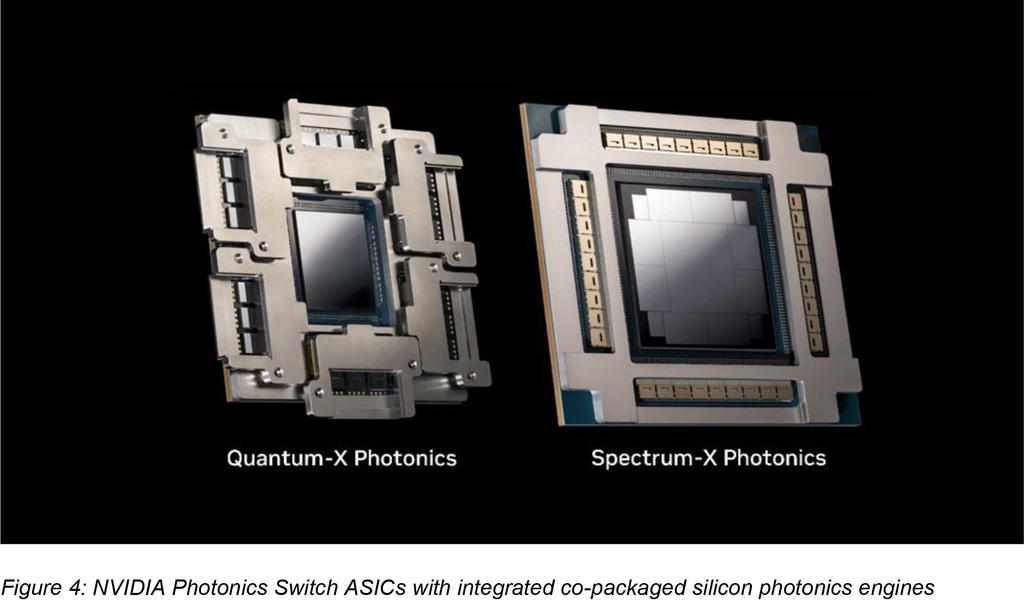

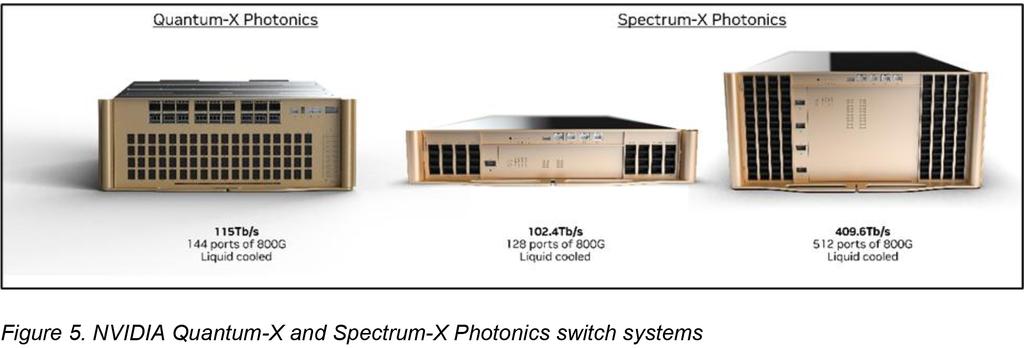

- 핵심 기술: 고대역폭 네트워킹 기술이 시스템 전반에 적용됩니다.

- 통합: Compute 칩과 칩 사이, 그리고 랙(Rack) 간의 데이터 전송 속도를 병목 현상 없이 유지하는 것이 중요합니다.

- 네트워킹 설계: 수많은 노드를 하나의 거대한 연산 클러스터처럼 작동하게 만드는 데 집중합니다.

3. 시스템 레벨 아키텍처 및 구현

- 시스템 통합: CPU, GPU(가속기), 그리고 고속 인터커넥트가 하나의 매끄러운 플랫폼으로 통합됩니다.

- 고객 가치: 최종 고객(클라우드 서비스 제공업체, 대규모 연구소 등)에게는 전례 없는 규모의 AI 슈퍼컴퓨팅 파워를 제공하는 것이 목표입니다.

세부 기술 요소별 정리

세부 기술 요소별 정리

| 영역 | 핵심 컴포넌트/기술 | 주요 기능 및 중요성 |

|---|---|---|

| AI 가속기 | Rubin 아키텍처 | 차세대 AI 연산의 핵심. LLM 추론 및 학습 워크로드 구동. |

| 시스템 연결성 | 고대역폭 인터커넥트 | 수많은 칩 간의 데이터 전송 속도 유지. 시스템의 전체 성능을 결정하는 병목 해소. |

| 클라우드 통합 | 네트워킹 클러스터링 | 여러 칩을 거대한 단일 연산 자원으로 묶어 클라우드 서비스 제공 능력 극대화. |

| 네트워킹 구현 | 고속 트랜시버, 광학 솔루션 | 데이터센터 규모에서 필요한 초저지연, 고대역폭 통신 환경 제공. |

| 엣지/로컬 적용 | 엣지 컴퓨팅 연계 | 대규모 데이터센터뿐 아니라 현장(Edge)에서도 AI 기능을 구동할 수 있도록 플랫폼 확장성을 확보. |

예상되는 질문 및 답변

예상되는 질문 및 답변

Q1. 이 기술 스택의 가장 큰 혁신 포인트는 무엇인가요?

A1. 과거에는 칩의 성능이 중요했지만, 이제는 **칩 간의 연결성(Interconnect)**이 가장 중요합니다. 이 문서는 칩 자체의 성능과 더불어, 수백/수천 개의 칩을 지연 없이 거대한 하나의 병렬 컴퓨팅 자원으로 묶어내는 시스템 통합 능력을 강조하고 있습니다.

Q2. 이 기술이 일반 사용자나 기업에 미치는 영향은 무엇인가요?

A2. AI 모델을 더 빠르고, 더 크게 만들 수 있다는 의미입니다. 이는 곧 AI 기반 서비스의 상용화 속도를 높이고, 기업들이 더욱 복잡하고 고도화된 AI 솔루션(예: 신약 개발, 자율주행, 초개인화 서비스)을 사용할 수 있게 됨을 의미합니다.

Q3. '루비(Rubin)'와 같은 이름은 새로운 세대의 칩을 지칭하는 것인가요?

A3. 네, 그렇습니다. 이름이 붙은 아키텍처(Rubin)는 엔비디아가 자체적으로 설계하고 개발하는 차세대 반도체 구조를 지칭하며, 이전 세대 대비 성능과 효율성이 비약적으로 향상된 제품 라인업을 기대할 수 있습니다.