칩이 구글의 맞춤형 실리콘 포트폴리오를 완성했다.

오늘 Google Cloud는 자사의 Axion CPU와 Ironwood TPU를 기반으로 하는 새로운 AI 전용 인스턴스를 공개했습니다. 이 인스턴스는 대규모 AI 모델의 훈련(training)과 저지연 추론(low-latency inference) 모두를 겨냥하고 있으며, 핵심 특징은 Google의 Ironwood 기반 시스템이 매우 큰 스케일업 환경을 통해 AI 모델의 효율적인 확장이 가능하다는 점입니다.

수백만 개의 Ironwood TPU를 활용한 훈련 및 추론

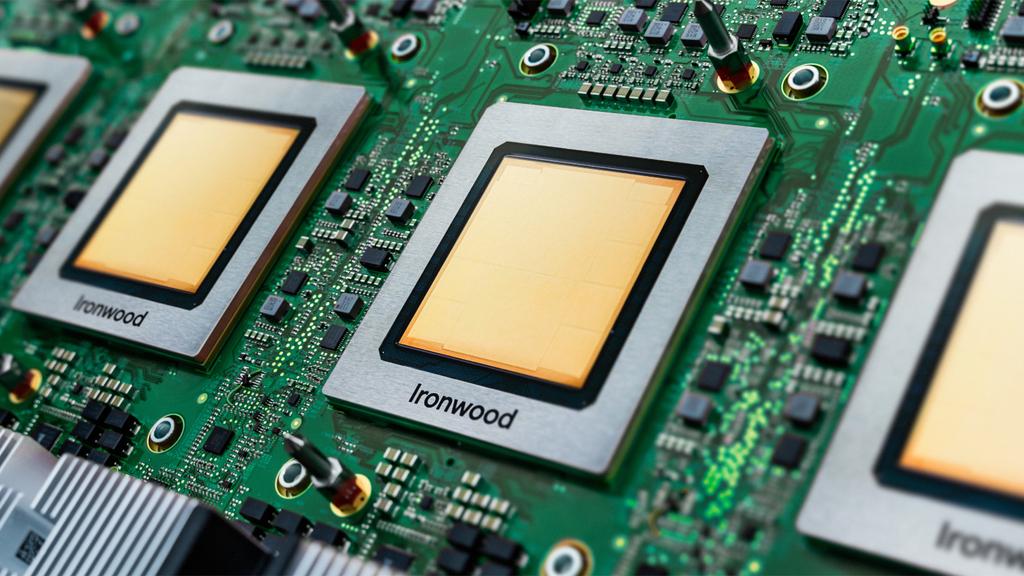

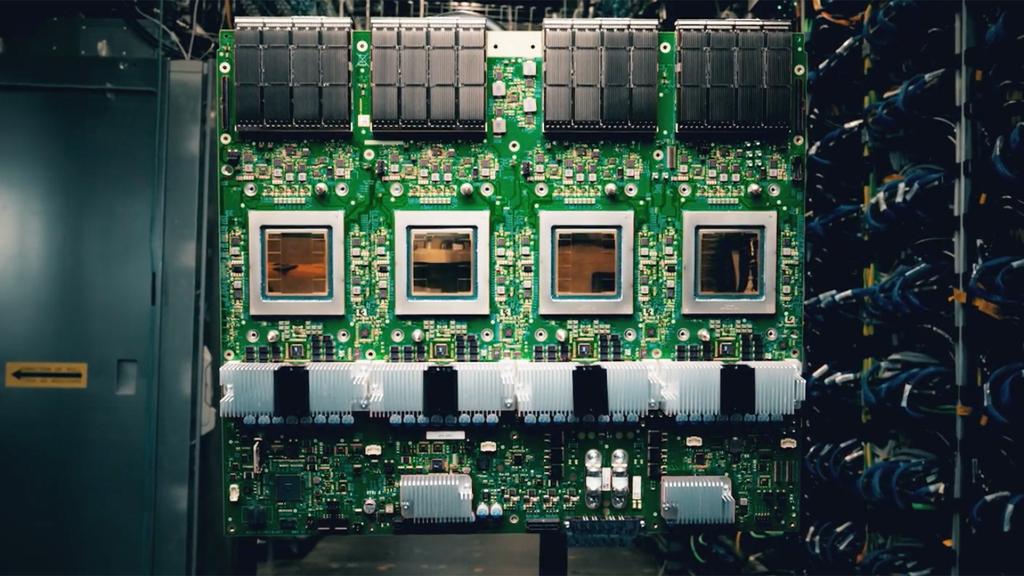

Ironwood는 Google의 7세대 텐서 처리 장치(TPU)로, 4,614 FP8 TFLOPS의 성능을 제공하며 최대 7.37 TB/s의 대역폭을 가진 192GB의 HBM3E 메모리가 장착되어 있습니다. Ironwood 포드는 최대 9,216개의 AI 가속기까지 확장할 수 있으며, 훈련 및 추론에 총 42.5 FP8 ExaFLOPS를 제공합니다. 이는 현존하는 Nvidia의 GB300 NVL72 시스템(0.36 ExaFLOPS)의 FP8 성능을 압도적으로 초과하는 수치입니다. 이 포드는 독점적인 9.6 Tb/s의 인터-칩 인터커넥트(Inter-Chip Interconnect) 네트워크로 상호 연결되며, 총 약 1.77 PB의 HBM3E 메모리를 내장하여 Nvidia의 경쟁 플랫폼이 제공할 수 있는 수준을 다시 한번 능가합니다.

Axion CPU와 Ironwood TPU 기반 Ironwood 포드는 수십만 개의 TPU로 구성된 클러스터로 연결될 수 있으며, 이는 Google가 'AI 하이퍼컴퓨터'라고 명명한 시스템의 일부를 이룹니다. 이 시스템은 컴퓨팅, 스토리지, 네트워킹을 하나의 관리 계층으로 통합한 통합 슈퍼컴퓨팅 플랫폼입니다. Google은 초대형 포드와 AI 하이퍼컴퓨터 전체의 신뢰성을 높이기 위해 Optical Circuit Switching이라는 재구성 가능한 패브릭(reconfigurable fabric)을 사용합니다. 이를 통해 모든 하드웨어 장애를 즉시 우회하여 연속적인 운영을 보장합니다.

인텔과 구글, 다년 계약 발표

메타의 새로운 MTIA 라인업, 하이퍼스케일러들의 전용 추론 칩 통합 공세에 합류

IDC 데이터에 따르면, AI 하이퍼컴퓨터 모델은 엔터프라이즈 고객을 대상으로 평균 353%의 3년 ROI(투자 수익률), 28%의 IT 지출 절감, 그리고 55%의 운영 효율성 증가를 가져온 것으로 평가되었습니다.

이미 여러 기업들이 Google의 Ironwood 기반 플랫폼을 채택하고 있습니다. Anthropic은 주요 비용-성능 개선 효과를 언급하며, 자사의 Claude 모델군 운영 및 확장을 위해 최대 100만 개의 TPU를 활용할 계획입니다. Lightricks 역시 Ironwood를 배포하여 LTX-2 멀티모달 시스템 훈련 및 서비스에 활용하기 시작했습니다.

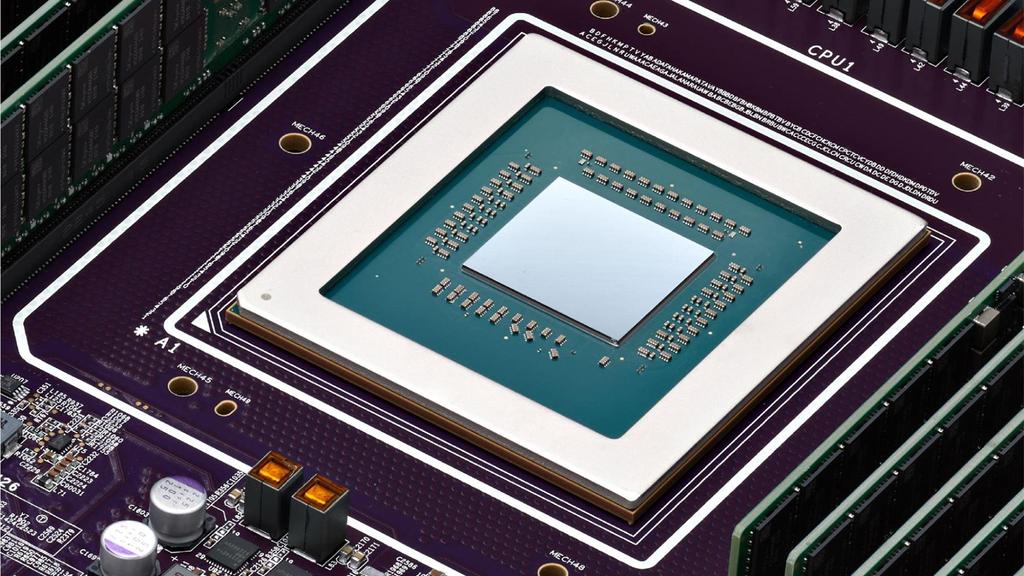

Google의 Ironwood와 같은 AI 가속기가 컴퓨팅 시대의 핵심 동력이 되고 있지만, CPU는 여전히 애플리케이션 로직 수행, 서비스 호스팅, 그리고 데이터 수집(data ingestion)과 같은 일부 AI 워크로드를 구동하는 데 결정적으로 중요합니다. 따라서 Google은 7세대 TPU와 더불어 Axion이라는 최초의 Armv9 기반 범용 프로세서도 함께 배포합니다.

Google은 Axion CPU의 전체 다이 사양을 공개하지 않았습니다. 현재까지 확인된 코어 수(C4A Metal 인스턴스 기준 최대 96 vCPU 및 최대 768GB DDR5 메모리 초과 없음), 공개 클럭 속도, 또는 공정 노드에 대한 정보는 없습니다. 다만, Axion은 Arm Neoverse v2 플랫폼을 기반으로 설계되었으며, 최신 x86 CPU 대비 최대 50% 향상된 성능과 최대 60% 높은 에너지 효율성을 제공하도록 설계되었으며, 현재 클라우드에서 사용 가능한 가장 빠른 범용 Arm 기반 인스턴스보다 30% 높은 성능을 보여준다고 합니다. 이 CPU는 코어당 2MB의 사설 L2 캐시, 80MB의 L3 캐시를 제공하고, DDR5-5600 메모리 및 균일한 메모리 대역폭(Uniform Memory Access, UMA)을 지원합니다.

주요 제품군:

- Axon Processor: 차세대 인공지능 연산에 최적화된 프로세서입니다.

- Google Cloud Infrastructure: 거대 규모의 클라우드 컴퓨팅 역량을 제공합니다.

제품 개요:

- Axon: AI 가속에 특화된 프로세서입니다.

- Cloud Infrastructure: 다양한 클라우드 서비스를 제공합니다.

개요:

- Axon: AI 성능을 극대화합니다.

- Google Cloud: 강력한 클라우드 인프라를 제공합니다.

최종 검토:

- Axon: AI 성능이 우수합니다.

- Cloud: 클라우드 서비스가 강력합니다.

결론적으로, 이 글의 구조와 내용은 아래와 같습니다.

- 초반부: Axon 프로세서와 Google Cloud Infrastructure 전반에 대한 개요 소개.

- 중반부: Axon의 특징 (AI 가속 특화, 프로세서 설명)과 Google Cloud의 특징 (대규모 클라우드 제공)을 대비/결합 설명.

- 후반부: 제품별 구체적인 사양 및 활용 방안 제시. (이 부분은 원문에서 혼재되어 있어 명확히 재구성해야 함)

최종 권장 구조:

[서론/개요] -> [제품 A 상세 (Axon)] -> [제품 B 상세 (Google Cloud)] -> [통합 활용 및 결론]

(참고: 마지막 몇 개의 블록은 원문의 일부가 누락되거나 중복되는 것으로 보여, 제외하고 최종 버전만 제공하는 것이 최선입니다.)