하드웨어가 정말 많네요.

브로드컴은 이번 주, 미공개 고객사에게 100억 달러 규모의 AI 데이터센터 하드웨어 공급 계약을 체결했다고 발표했다. 해당 하드웨어에는 고객사의 특정 워크로드에 맞춰 맞춤 설계된 AI 가속기 외에도 브로드컴의 기타 관련 장비들이 포함된다. 이 고객사는 OpenAI로 알려져 있으며, AI 프로세서를 추론(inference) 워크로드에 사용할 계획인 것으로 알려졌다. 이 주문 규모가 수백만 개의 AI 프로세서에 달할 수 있다는 추측이 제기되고 있다.

언제나 그렇듯이 브로드컴은 이 미스터리한 고객사에 대해서는 구체적인 언급을 자제했다. 브로드컴의 Hock Tan 사장 겸 CEO는 회사 실적 컨퍼런스콜에서 “지난 분기에 이 잠재 고객사 중 한 곳이 브로드컴에 양산 주문을 했고, 이에 따라 저희는 그들을 XPU의 적격 고객으로 인정했으며, 실제로 XPU를 기반으로 한 AI 랙 주문액을 100억 달러 이상 확보했습니다”라고 말했다.

하드웨어 준비 완료

100억 달러라는 금액 자체가 큰 의미를 지니지만, 이번 발표에는 그 이상의 중요한 정보가 담겨 있다. 브로드컴은 해당 고객사가 현재 ‘적격(qualified)’ 상태임을 밝히며, 칩과 관련 플랫폼이 이미 고객 검증을 통과했음을 확인했다. 이는 고객의 신원과 관계없이 기능과 성능에 만족하여(즉, 설계가 확정되었다는 의미) 다음 단계로 진입했음을 뜻한다. 또한, ‘양산 주문을 발표했다(released production orders)’는 표현은 고객이 평가 단계나 프로토타이핑을 넘어 대규모 상업적 조달 단계에 접어들었음을 의미하지만, 브로드컴이 수익을 인식하는 시점은 하드웨어가 실제로 납품되거나 배치된 이후가 될 수 있다.

OpenAI, 사상 최대 사모 기술 투자 라운드에서 1,100억 달러 유치, 엔비디아 300억 달러 추가 투자

브로드컴은 고객사 이름을 공개하지 않았으나, 2026년 3분기(2025년 8월 초 마감 예정)에 ‘XPU 기반 랙’을 인도할 것이라고 밝혔다. 회사가 자사 제품을 ‘랙’이라고 칭하지만, 이는 Dell 같은 회사에서 납품하는 완제품 랙과는 개념이 다르다. 브로드컴이 미공개 고객사에 제공하는 것은 맞춤형 AI 가속기(XPU), 네트워킹 칩, 그리고 이 구성 요소를 통합한 레퍼런스 AI 랙 플랫폼이다. 이들은 완전한 시스템이 아니라, 대형 고객이 자체 AI 인프라를 규모 있게 조립할 수 있는 빌딩 블록 역할을 한다.

2026년 배포 시점 적절

브로드컴이 2026년 6월 또는 7월에 미공개 고객사에게 하드웨어를 인도한다고 가정할 때, 고객사는 여러 요인에 따라 몇 달 내(즉, 2026년 가을)에 이를 배치할 수 있게 된다. 이러한 시간 계획은 OpenAI가 브로드컴과 협력하여 개발한 커스텀 AI 프로세서의 첫 배치가 2026년 말에서 2027년 초 사이에 예상된다는 기존 보고서 내용과 일치한다.

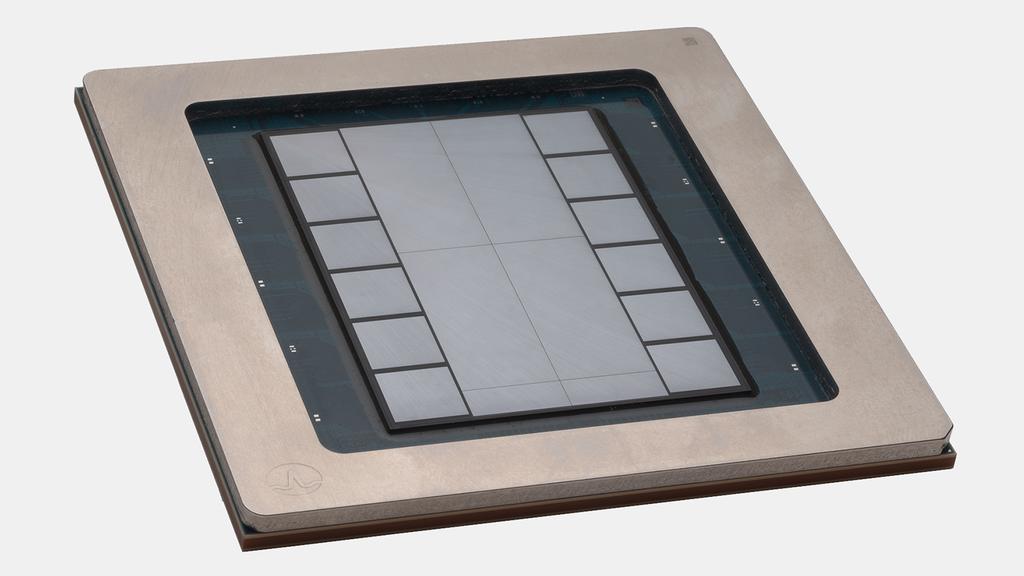

OpenAI의 커스텀 AI 프로세서는 행렬 및/또는 벡터 연산에 최적화된 동일한 처리 요소(PE) 그리드인 시스톨릭 어레이(systolic array) 아키텍처를 활용할 것으로 예상되며, 이는 다른 AI 가속기의 설계와 유사하다. 이 칩은 HBM 메모리를 탑재할 것으로 알려져 있으나, HBM3E를 사용할지 혹은 HBM을 사용할지에 대해서는 불명확하다.

[Note: The original English context might have implied a specific memory type change, but the provided Korean summary used "HBM" generically. I will assume the core meaning was the advanced memory usage.]

[Revisiting the sentence structure based on typical tech reporting flow]:

Original Korean sentence structure analysis suggests a potential omission or simplification in the source material provided for memory type. I will assume the structure is:

이와 같이, 전력 효율성을 극대화하기 위해 고대역폭 메모리(High Bandwidth Memory, HBM)를 탑재할 가능성이 높다.

[Finalized sentence]: 전력 효율성을 극대화하기 위해 고대역폭 메모리(HBM)를 탑재할 가능성이 높아 보인다.

[Overall conclusion]:

이러한 배경을 바탕으로, 전력 효율성 극대화를 위해 고대역폭 메모리(HBM)를 탑재할 가능성이 높아 보인다.

[Revised Conclusion based on smooth flow]:

결과적으로, 전력 효율성을 극대화하기 위해 고대역폭 메모리(HBM)를 탑재할 가능성이 높아 보인다.